Ученые обеспокоены влиянием искусственного интеллекта на наше общество

Профессор Ланкастерского университета в сфере международной безопасности, Джо Бертон утверждает, что ИИ и алгоритмы — это не только инструменты, которые органы национальной безопасности используют для предотвращения вредоносных действий в интернете.

Новейшие технологии могут быть использованы злоумышленниками для повышения градуса поляризации, распространения радикализма и способствования политическому насилию, что несет угрозу национальной безопасности. Более того, процессы секьюритизации, представляющие развивающиеся технологии как экзистенциальную угрозу, сыграли ключевую роль при разработке ИИ и, в результате, оказали пагубное влияние на международную безопасность.

Статья профессора Бёртона «Алгоритмический экстремизм? Секьюритизация искусственного интеллекта (ИИ) и ее воздействие на радикализм, поляризацию и политическое насилие» опубликована в журнале Technology in Society. В работе рассматривается, как ИИ был секьюритизирован на протяжении всей своей истории в представлении средств массовой информации и популярной культуры, а также в ходе изучения современных примеров поляризующего и радикализующего воздействия ИИ.

Автор приводит в пример классическую серию фильмов «Терминатор», в которой изображается геноцид, совершенный «гениальным и зловещим» искусственным интеллектом, и утверждает, что эти фильмы внесли огромный вклад в общественное мнение об угрозе ИИ. В художественном произведении появление машин с сознанием привело к разрушительным последствиям для человечества — ядерной войне и преднамеренной попытке уничтожения всего человеческого вида.

— Джо Бертон, профессор Ланкастерского университета в сфере международной безопасности.

Возможности дронов, например тех, что используются в войне на Украине, по словам профессора Бертона включают в себя полную автономность, используя такие функции как идентификация и распознавание целей. И хотя проводилась широкая и влиятельная компания о запрете «роботов-убийц» и сохранении эксклюзивности роли человека в принятии влияющих на свою и чужие жизни решений, интеграция вооруженных дронов продолжается быстрыми темпами.

В области кибербезопасности ИИ используется в значительной степени, причем наиболее распространенной областью является дезинформация и психологическая война в сети. В качестве примера подобных действий автор приводит атаку на избирательные процессы в США в 2016 году и последующий скандал с Cambridge Analytica. Эти события показали потенциал ИИ в создании мнений, связанных с поляризацией и поощрением радикальных убеждений.

Работа профессора Бертона исследует и саму технологию ИИ. В статье утверждается, что проблемы лежат в разработке алгоритмов, обучающих данных и в способах взаимодействия людей с машинами. Статья заканчивается посланием исследователям, работающим в области кибербезопасности и международных отношений.

—Джо Бертон.

Новейшие технологии могут быть использованы злоумышленниками для повышения градуса поляризации, распространения радикализма и способствования политическому насилию, что несет угрозу национальной безопасности. Более того, процессы секьюритизации, представляющие развивающиеся технологии как экзистенциальную угрозу, сыграли ключевую роль при разработке ИИ и, в результате, оказали пагубное влияние на международную безопасность.

Статья профессора Бёртона «Алгоритмический экстремизм? Секьюритизация искусственного интеллекта (ИИ) и ее воздействие на радикализм, поляризацию и политическое насилие» опубликована в журнале Technology in Society. В работе рассматривается, как ИИ был секьюритизирован на протяжении всей своей истории в представлении средств массовой информации и популярной культуры, а также в ходе изучения современных примеров поляризующего и радикализующего воздействия ИИ.

Автор приводит в пример классическую серию фильмов «Терминатор», в которой изображается геноцид, совершенный «гениальным и зловещим» искусственным интеллектом, и утверждает, что эти фильмы внесли огромный вклад в общественное мнение об угрозе ИИ. В художественном произведении появление машин с сознанием привело к разрушительным последствиям для человечества — ядерной войне и преднамеренной попытке уничтожения всего человеческого вида.

Это недоверие к машинам, связанные с ними опасения и ассоциация с биологическими, ядерными и генетическими угрозами человечеству способствовали желанию правительств и национальных агентств по безопасности влиять на разработку технологий, чтобы снизить риски и использовать их положительные возможности

— Джо Бертон, профессор Ланкастерского университета в сфере международной безопасности.

Роботы-убийцы и манипуляторы

Возможности дронов, например тех, что используются в войне на Украине, по словам профессора Бертона включают в себя полную автономность, используя такие функции как идентификация и распознавание целей. И хотя проводилась широкая и влиятельная компания о запрете «роботов-убийц» и сохранении эксклюзивности роли человека в принятии влияющих на свою и чужие жизни решений, интеграция вооруженных дронов продолжается быстрыми темпами.

В области кибербезопасности ИИ используется в значительной степени, причем наиболее распространенной областью является дезинформация и психологическая война в сети. В качестве примера подобных действий автор приводит атаку на избирательные процессы в США в 2016 году и последующий скандал с Cambridge Analytica. Эти события показали потенциал ИИ в создании мнений, связанных с поляризацией и поощрением радикальных убеждений.

Работа профессора Бертона исследует и саму технологию ИИ. В статье утверждается, что проблемы лежат в разработке алгоритмов, обучающих данных и в способах взаимодействия людей с машинами. Статья заканчивается посланием исследователям, работающим в области кибербезопасности и международных отношений.

ИИ определенно способен трансформировать общества в позитивную сторону, но также имеет негативные факторы, которые необходимо изучать. Ученым, работающим в области кибербезопасности и международных отношений, предоставляется возможность включить эти факторы в разрабатываемую повестку дня исследований ИИ и не рассматривать ИИ как политически нейтральную технологию

—Джо Бертон.

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Новое исследование: Христофор Колумб — вообще не тот, кем его считали историки

Ученые даже назвали подлинное имя великого мореплавателя...

Еще одна тайна Аркаима разгадана: ученые объяснили, почему древний город построен именно на этом месте

Оказалось, что наши далекие предки очень умело использовали природную инфраструктуру и обладали инженерными знаниями...

Что за звуки сводили с ума смотрителей маяков: тайна разгадана учеными

Эксперты из Института поиска внеземного разума говорят: новое открытие в буквальном смысле открыло им глаза и уши...

4600-летний секрет «неубиваемости» Великой пирамиды раскрыт: все дело в специальных камерах

Древние инженеры опередили время на тысячелетия. Строение находится на своей частоте и гасит внешние вибрации...

Трехметровые осетры и тайна древнего русского города: историки раскрыли, как появилась Старая Ладога

Ответы на многие вопросы дали… 67 000 костей. Иногда, чтобы распутать исторический детектив, надо заглядывать не в хроники, а в мусорные кучи...

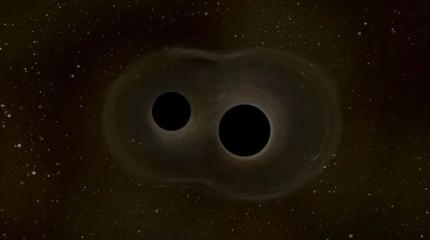

60 млрд Солнц в одной точке: что скрывает самая тяжелая пара черных дыр?

Секрет абсолютной пустоты, похоже, разгадан. Там нет вообще ничего: Ни пыли, ни газа, ни звезд...

В тени российского орла: сколько раз Петербург спасал Вашингтон от полной гибели?

Когда-то американцы клялись, что США будет дружить с Россией, покуда светят звезды. А сейчас делают вид, что не помнят...

Назад в будущее: почему Швеция запрещает смартфоны в школах и возвращается к бумажным учебникам?

По словам экспертов, отмена цифровизации сейчас происходит во многих странах. Неужели человечество одумалось и начинает выздоравливать?...

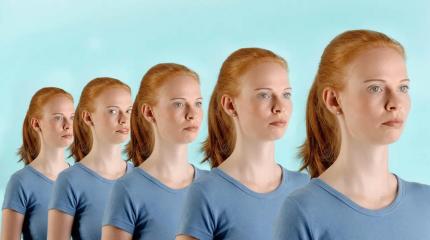

«Печать Евы»: почему у этих женщин рождаются только девочки

Оказалось, что старые теории вообще не работают. Но есть две мутации, которые могут усилить друг друга...

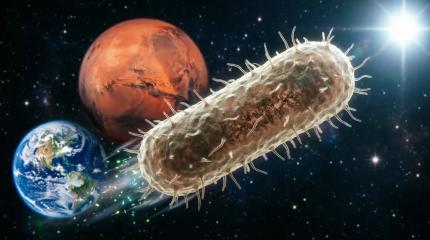

Мы все «марсиане»: ученые доказали, что жизнь с Красной планеты могла долететь за несколько лет

Компьютерное моделирование подтвердило: бактерии способны пережить Великий перенос с Марса на Землю. И этот процесс может идти прямо сейчас...

Снова утечка воздуха в российском секторе МКС: чем это грозит нашим и всей станции?

По словам специалистов: в 2026 году поломка вошла в цикл. Космонавты устраняют проблему, радуются, а через три недели — снова проблемы...

СССР был первым в энергии ветра: что помешало стать лидером планеты?

Это был невероятный и прорывной проект советского конструктора Юрия Кондратюка. Того самого, по расчетам которого, американцы полетели на Луну...

Странные звуки рядом с Кольской сверхглубокой снова беспокоят местных жителей

12 000 метров глубины, Луна под ногами, «совершенно секретно», неожиданное закрытие. Вспоминаем историю самой глубокой скважины на планете...