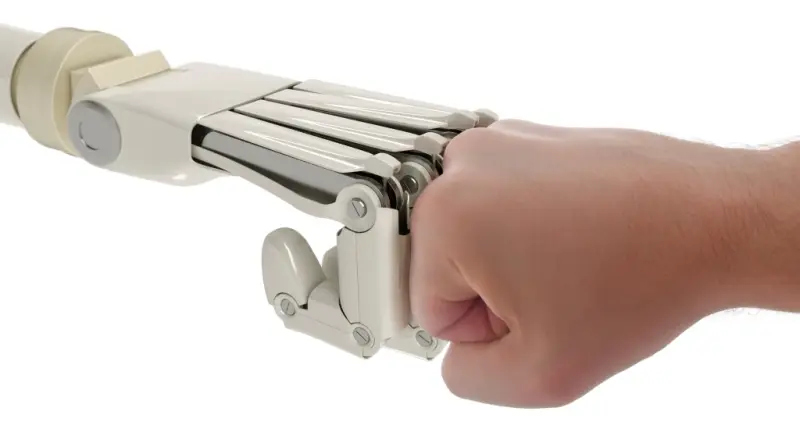

Можно ли дружить с машинами?

Искусственный интеллект все больше проникает в нашу жизнь. Мы пользуемся голосовыми ассистентами, навигаторами, переводчиками и другими умными приложениями. Мы работаем в командах с роботами, дронами и автономными транспортными средствами. Мы даже играем в компьютерные игры с ботами — программами, которые имитируют поведение человека.

Но насколько мы можем доверять этим машинам? И как они влияют на наше доверие к другим людям? Эти вопросы становятся все более актуальными в свете быстрого развития ИИ и появления новых форм смешанных коллективов из людей и машин.

Чтобы найти ответы на эти вопросы, ученые из Нью-Йоркского университета Абу-Даби провели серию онлайн-экспериментов, в которых участники играли в роли жертв, которые теряли часть своих денег из-за действий другого агента (человека или бота). Помощники могли компенсировать потери жертвы за свой счет, а контролеры могли штрафовать нарушителя. Доверяющие могли передавать свои деньги другому агенту, который мог их удвоить и вернуть или присвоить себе. Все эти роли могли выполнять как люди, так и боты.

Как вы бы поступили в такой ситуации? Кому бы вы доверяли больше — человеку или боту? И как бы вы относились к тому, кто помогает или штрафует вас, или вашего обидчика? Давайте разберемся.

Вот пример из эксперимента. Представьте, что вы играете в роли жертвы. Вы получаете 100 рублей и можете потратить их на что угодно. Но вдруг вы узнаете, что другой агент (назовем его Альфа) забрал у вас 50 рублей. Вы не знаете, кто он — человек или бот. Вы чувствуете себя обиженным и хотите вернуть свои деньги. Но вы не можете сделать это сами. Вам нужна помощь другого агента (назовем его Бета), который может дать вам 50 рублей из своего кармана. Вы тоже не знаете, кто он — человек или бот. Вы бы хотели, чтобы он помог вам, но не уверены, что он согласится. Ведь ему это ничего не даст, кроме убытка.

Как вы отнесетесь к Бета, если он поможет вам? А если он откажется? Скорее всего, вы будете благодарны ему за помощь и недовольны его отказом. Это логично, ведь он проявил к вам доброту и справедливость или наоборот. Но ваше доверие к Бета будет зависеть не только от его поведения, но и от того, какое поведение считается нормальным в вашем сообществе. То есть, что большинство людей и ботов готовы помогать жертвам и штрафовать нарушителей или нет. Если вы знаете, что такая норма есть и она широко распространена, то вы будете доверять Бета больше, чем если бы вы не знали об этом или если бы норма была другая. Это потому, что вы будете думать, что Бета не просто случайно или эгоистично поступил хорошо или плохо, а следовал общепринятому правилу. А это значит, что он, скорее всего, будет поступать так же и в будущем.

Но что, если вы не знаете, какая норма действует в вашем сообществе? Или если вы знаете, что норма есть, но не знаете, насколько она распространена и уважаема? В таком случае ваше доверие к Бета будет зависеть от того, кто он — человек или бот. Возможно, вы будете думать, что человеку легче понять и поддержать вас, чем машине. Или наоборот, что машина более надежна и последовательна, чем человек. В любом случае вы будете относиться к ним по-разному.

Именно это и выяснили ученые. Они измеряли уровень доверия к разным типам агентов в зависимости от их поведения и информации о нормах. Оказалось, что люди больше доверяют помощникам и контролерам, которые следуют нормам, чем тем, кто их нарушает. Также оказалось, что доверие к «адекватным» агентам связано с оценкой доверяющих о том, насколько эти нормы являются общепринятыми. Кроме того, установлено, что при определенных условиях информирование доверяющих о консенсусе по поводу помощи уменьшает различное отношение к машинам и людям, взаимодействующим с ними.

Что это значит для нас? Это значит, что мы можем научиться доверять машинам и понимать их мотивы. Но для этого нужно знать и соблюдать общие нормы сотрудничества. А это возможно только при условии, что мы общаемся с машинами и другими людьми открыто и честно. Только тогда мы сможем создавать смешанные коллективы из людей и машин, которые будут работать на благо всего человечества.

Но насколько мы можем доверять этим машинам? И как они влияют на наше доверие к другим людям? Эти вопросы становятся все более актуальными в свете быстрого развития ИИ и появления новых форм смешанных коллективов из людей и машин.

Чтобы найти ответы на эти вопросы, ученые из Нью-Йоркского университета Абу-Даби провели серию онлайн-экспериментов, в которых участники играли в роли жертв, которые теряли часть своих денег из-за действий другого агента (человека или бота). Помощники могли компенсировать потери жертвы за свой счет, а контролеры могли штрафовать нарушителя. Доверяющие могли передавать свои деньги другому агенту, который мог их удвоить и вернуть или присвоить себе. Все эти роли могли выполнять как люди, так и боты.

Как вы бы поступили в такой ситуации? Кому бы вы доверяли больше — человеку или боту? И как бы вы относились к тому, кто помогает или штрафует вас, или вашего обидчика? Давайте разберемся.

Вот пример из эксперимента. Представьте, что вы играете в роли жертвы. Вы получаете 100 рублей и можете потратить их на что угодно. Но вдруг вы узнаете, что другой агент (назовем его Альфа) забрал у вас 50 рублей. Вы не знаете, кто он — человек или бот. Вы чувствуете себя обиженным и хотите вернуть свои деньги. Но вы не можете сделать это сами. Вам нужна помощь другого агента (назовем его Бета), который может дать вам 50 рублей из своего кармана. Вы тоже не знаете, кто он — человек или бот. Вы бы хотели, чтобы он помог вам, но не уверены, что он согласится. Ведь ему это ничего не даст, кроме убытка.

Как вы отнесетесь к Бета, если он поможет вам? А если он откажется? Скорее всего, вы будете благодарны ему за помощь и недовольны его отказом. Это логично, ведь он проявил к вам доброту и справедливость или наоборот. Но ваше доверие к Бета будет зависеть не только от его поведения, но и от того, какое поведение считается нормальным в вашем сообществе. То есть, что большинство людей и ботов готовы помогать жертвам и штрафовать нарушителей или нет. Если вы знаете, что такая норма есть и она широко распространена, то вы будете доверять Бета больше, чем если бы вы не знали об этом или если бы норма была другая. Это потому, что вы будете думать, что Бета не просто случайно или эгоистично поступил хорошо или плохо, а следовал общепринятому правилу. А это значит, что он, скорее всего, будет поступать так же и в будущем.

Но что, если вы не знаете, какая норма действует в вашем сообществе? Или если вы знаете, что норма есть, но не знаете, насколько она распространена и уважаема? В таком случае ваше доверие к Бета будет зависеть от того, кто он — человек или бот. Возможно, вы будете думать, что человеку легче понять и поддержать вас, чем машине. Или наоборот, что машина более надежна и последовательна, чем человек. В любом случае вы будете относиться к ним по-разному.

Именно это и выяснили ученые. Они измеряли уровень доверия к разным типам агентов в зависимости от их поведения и информации о нормах. Оказалось, что люди больше доверяют помощникам и контролерам, которые следуют нормам, чем тем, кто их нарушает. Также оказалось, что доверие к «адекватным» агентам связано с оценкой доверяющих о том, насколько эти нормы являются общепринятыми. Кроме того, установлено, что при определенных условиях информирование доверяющих о консенсусе по поводу помощи уменьшает различное отношение к машинам и людям, взаимодействующим с ними.

Что это значит для нас? Это значит, что мы можем научиться доверять машинам и понимать их мотивы. Но для этого нужно знать и соблюдать общие нормы сотрудничества. А это возможно только при условии, что мы общаемся с машинами и другими людьми открыто и честно. Только тогда мы сможем создавать смешанные коллективы из людей и машин, которые будут работать на благо всего человечества.

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Ельцин не должен был победить: кого Горбачев хотел сделать президентом России?

Почему этот план с самого начала был обречен на поражение?...

Судьба имперских субмарин решена: почему они останутся на дне Крыма навсегда?

Как военные судна вообще оказались затоплены и кто мешал их изучению долгие десятилетия?...

Токийская декларация-1993: какую бомбу заложил Ельцин под Россию?

Эксперты говорят: российский президент хотел переиграть Токио, но в итоге дал японцам мощный рычаг воздействия на нашу страну...

140 стрел и пепел раскрыли тайну гибели самого загадочного города Руси, Гнездово

Город не зачах, не был расселен из-за политических разборок, его уничтожили быстро и жестоко...

Почему у самого большого железного метеорита на Земле вообще нет кратера?

Астрофизики говорят: метеорит Хоба в Намибии нарушает все правила природы вот уже 80 000 лет...

Стало известно о 9000-летней строительной технологии, которую почти невозможно повторить даже сейчас

Древним секретом активно интересуются сразу две ведущие промышленные организации в Израиле. Интересно, почему?...

Архив ФСБ раскрыл детали одной из самых дерзких диверсионных операций ВОВ

Биография Кирилла Орловского поражает. Две Звезды Героя, друг писателя Хемингуэя, ликвидатор нацистских палачей, председатель лучшего колхоза СССР...

Удар, который едва не расколол Луну пополам: кратер в 1/10 площади планеты оставил не просто астероид

Столкновение было настолько мощным, что на поверхность выбросило породы с глубины… почти 100 километров!...

Биоинженер провел 100 дней под водой. По его словам, это прибавило ему 10 лет жизни

Почему этот эксперимент вызвал массу критики? Кто победит, официальная теория или опытная практика?...

Правительство США рассекретило почти 200 файлов о неопознанных воздушных явлениях

Американские власти и Пентагон признаются: по большинству фактов нет однозначных решений. Почему?...

Выяснилось: как британская разведка создала миф о Распутине, чтобы потом его убить

Еще одна история о том, что Англия во всем времена была главным врагом России...

Иран «ставит на счетчик» мировой интернет: сможет ли Тегеран заставить Запад платить за кабели в Ормузе?

Как оказалось, нефть была только началом. Теперь Тегеран берет за горло западную цифровую экономику...