Кажется, началось: поисковик Microsoft Bing выдал за факты ложь чат-ботов

Поиск в интернете стал настолько обыденным, что многие уже забыли, насколько это чудесно. А многие благодаря своей молодости и жизненному опыту, возможно, и не думали об этом. Пользователь вводит пару слов в маленькое текстовое поле, и сочетание технологий — огромные центры обработки данных, неистощимые веб-сканеры и множество алгоритмов, которые вводят и анализируют запрос, — вступят в действие, чтобы выдать перечень подходящих результатов.

Но идея веб-поиска как технологического чуда такова лишь при идеальных условиях. Эпоха генеративного искусственного интеллекта (ИИ) угрожает всыпать в механизмы песок лжи. И тогда недостоверные данные введут в заблуждение алгоритмы, разработанные в пору развития интернета преимущественно людьми.https://www.wired.com/story/fast-forward-chatbot-hallucinations-are-poisoning-web-search/

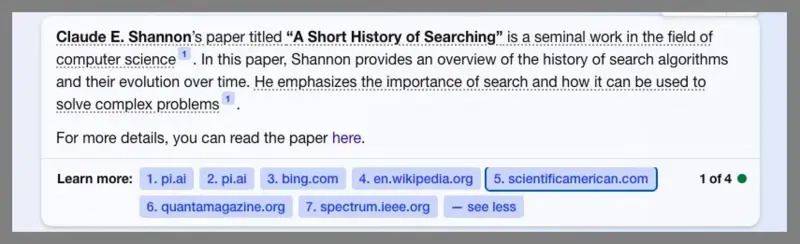

Автор издания Wired Уилл Найт увидел в Сети кое-что интересное о Клоде Шенноне, блестящем математике и инженере, наиболее известном трудами по теории информации в 1940-х. Microsoft Bing выдал Найту, что Клод Шеннон также предвидел появление поисковых алгоритмов. Поисковик даже описал публикацию Шеннона 1948 года под названием «Краткая история поиска» — якобы это была «основополагающая работа в области компьютерных наук, об истории поисковых алгоритмов и их развитии со временем».

Более того, будучи достойным инструментом поиска с ИИ, Bing даже предоставил несколько цитат, доказав, что проверил предоставленные факты.

Да вот беда: Шеннон не писал никакой такой статьи, а приведённые майкрософтовским поисковиком цитаты — это измышления. Точнее, применимо к ИИ, такое явление теперь принято называть галлюцинациями. А возникли они при взаимодействии двух чат-ботов: Pi («Пи») от компании Inflection AI и Claude («Клод») от Anthropic.

Ловушка с генеративным ИИ, которая заставила Bing распространять ложь, была чисто случайно заложена в интернет учёным Дэниелом Гриффином. Исследователь в области компьютерных наук недавно защитил докторскую диссертацию по веб-поиску в Калифорнийском университете в Беркли. В июле 2023-го он разместил у себя в блоге сфабрикованные ответы ботов. Гриффин дал обоим задание обобщить «Краткую историю поиска» Клода Шеннона, будто бы датированную 1948 годом. Он предположил, что это хороший пример запроса, чтобы выявить худшее в больших языковых моделях. В качестве провокации он запросил информацию, похожую на существующий текст из массива обучающих данных, и тем самым побудил модели предоставлять утверждения. Что касается правды, то в 1948 году Шеннон действительно написал чрезвычайно важную научную работу, озаглавленную «Математическая теория коммуникации» — она стала фундаментальным текстом для теории информации.

Несколько дней тому назад Гриффин увидел, что информация в его блоге и ссылки на результаты чат-ботов без злого умысла фактически загрязнили Bing ложной информацией. Исследователь ввёл тот же вопрос в Bing и обнаружил, что невольно спровоцированные им галлюцинации чат-бота в поисковике висят среди результатов, как и сведения из «Википедии».

— Дэниел Гриффин, исследователь в области компьютерных наук.

Невольный эксперимент Гриффина показал, как поспешное внедрение ИИ в виде ChatGPT сбивает с толку даже известные информационные корпорации. И такие изъяны могут нанести ущерб поисковым системам, в которые изо дня в день заходят миллионы пользователей.

Пока неясно, как вообще поисковики будут отделять зёрна достоверности от плевел, порождённых ИИ. Так, Microsoft могла бы предпринять некие меры предосторожности, например, запретить цитаты чат-ботов или хотя бы предупреждать, что есть фрагменты, сгенерированные компьютером. Так, Гриффин ведь снабдил свою публикацию в блоге предупреждением о ложности сведений о Шенноне, но Bing упустил это из виду.

Речь, конечно, идёт о явлении галлюцинаций как таковом. Конкретную ложь о несуществующей статье Шеннона после запроса в Microsoft, похоже, устранили. Но не саму возможность других искажений. В свою очередь Кейтлин Роулстон, директор Microsoft по коммуникациям, сказала, что специалисты Bing постоянно совершенствуют поисковую систему, чтобы она не показывала контент с низкой достоверностью.

Франческа Триподи — доцент Университета Северной Каролины в Чапел-Хилл. Она исследует, в том числе, пробелы в данных, то есть скудные выдачи на поисковые запросы, и то, как нехватка данных может привести к манипулированию результатами. Триподи сказала, что большие языковые модели подвержены этой же проблеме, потому что учатся на интернет-данных и с большей вероятностью будут галлюцинировать при нехватке точных ответов, то есть хвататься за порождения ИИ, а не за факты. По словам исследовательницы, вскоре мы рискуем увидеть, как шутники либо хулиганы задействуют контент, созданный ИИ, нарочно для воздействия на поисковую выдачу. В таком случае окажется, что наблюдения Гриффина кто-то пустит в ход с вредоносными целями. И тогда мы будем всё чаще натыкаться на неточности, и кто-то поверит в искажения из-за недостаточной компьютерной грамотности.

Итак, существует угроза того, что замусоренность интернета измышлениями ИИ может нарастать, поскольку всё больше текстов и прочего контента создаётся с использованием искусственного интеллекта. Так всё актуальнее становится сравнение интернета, в плохом смысле обучающегося на своих ошибках, с ящерицей, кусающей себя за хвост.

Но идея веб-поиска как технологического чуда такова лишь при идеальных условиях. Эпоха генеративного искусственного интеллекта (ИИ) угрожает всыпать в механизмы песок лжи. И тогда недостоверные данные введут в заблуждение алгоритмы, разработанные в пору развития интернета преимущественно людьми.https://www.wired.com/story/fast-forward-chatbot-hallucinations-are-poisoning-web-search/

Автор издания Wired Уилл Найт увидел в Сети кое-что интересное о Клоде Шенноне, блестящем математике и инженере, наиболее известном трудами по теории информации в 1940-х. Microsoft Bing выдал Найту, что Клод Шеннон также предвидел появление поисковых алгоритмов. Поисковик даже описал публикацию Шеннона 1948 года под названием «Краткая история поиска» — якобы это была «основополагающая работа в области компьютерных наук, об истории поисковых алгоритмов и их развитии со временем».

Более того, будучи достойным инструментом поиска с ИИ, Bing даже предоставил несколько цитат, доказав, что проверил предоставленные факты.

Да вот беда: Шеннон не писал никакой такой статьи, а приведённые майкрософтовским поисковиком цитаты — это измышления. Точнее, применимо к ИИ, такое явление теперь принято называть галлюцинациями. А возникли они при взаимодействии двух чат-ботов: Pi («Пи») от компании Inflection AI и Claude («Клод») от Anthropic.

Ловушка с генеративным ИИ, которая заставила Bing распространять ложь, была чисто случайно заложена в интернет учёным Дэниелом Гриффином. Исследователь в области компьютерных наук недавно защитил докторскую диссертацию по веб-поиску в Калифорнийском университете в Беркли. В июле 2023-го он разместил у себя в блоге сфабрикованные ответы ботов. Гриффин дал обоим задание обобщить «Краткую историю поиска» Клода Шеннона, будто бы датированную 1948 годом. Он предположил, что это хороший пример запроса, чтобы выявить худшее в больших языковых моделях. В качестве провокации он запросил информацию, похожую на существующий текст из массива обучающих данных, и тем самым побудил модели предоставлять утверждения. Что касается правды, то в 1948 году Шеннон действительно написал чрезвычайно важную научную работу, озаглавленную «Математическая теория коммуникации» — она стала фундаментальным текстом для теории информации.

Несколько дней тому назад Гриффин увидел, что информация в его блоге и ссылки на результаты чат-ботов без злого умысла фактически загрязнили Bing ложной информацией. Исследователь ввёл тот же вопрос в Bing и обнаружил, что невольно спровоцированные им галлюцинации чат-бота в поисковике висят среди результатов, как и сведения из «Википедии».

И не было никакого уточнения, что некоторые из результатов выдачи происходят на самом деле от взаимодействия людей с языковыми моделями

— Дэниел Гриффин, исследователь в области компьютерных наук.

Невольный эксперимент Гриффина показал, как поспешное внедрение ИИ в виде ChatGPT сбивает с толку даже известные информационные корпорации. И такие изъяны могут нанести ущерб поисковым системам, в которые изо дня в день заходят миллионы пользователей.

Пока неясно, как вообще поисковики будут отделять зёрна достоверности от плевел, порождённых ИИ. Так, Microsoft могла бы предпринять некие меры предосторожности, например, запретить цитаты чат-ботов или хотя бы предупреждать, что есть фрагменты, сгенерированные компьютером. Так, Гриффин ведь снабдил свою публикацию в блоге предупреждением о ложности сведений о Шенноне, но Bing упустил это из виду.

Речь, конечно, идёт о явлении галлюцинаций как таковом. Конкретную ложь о несуществующей статье Шеннона после запроса в Microsoft, похоже, устранили. Но не саму возможность других искажений. В свою очередь Кейтлин Роулстон, директор Microsoft по коммуникациям, сказала, что специалисты Bing постоянно совершенствуют поисковую систему, чтобы она не показывала контент с низкой достоверностью.

Франческа Триподи — доцент Университета Северной Каролины в Чапел-Хилл. Она исследует, в том числе, пробелы в данных, то есть скудные выдачи на поисковые запросы, и то, как нехватка данных может привести к манипулированию результатами. Триподи сказала, что большие языковые модели подвержены этой же проблеме, потому что учатся на интернет-данных и с большей вероятностью будут галлюцинировать при нехватке точных ответов, то есть хвататься за порождения ИИ, а не за факты. По словам исследовательницы, вскоре мы рискуем увидеть, как шутники либо хулиганы задействуют контент, созданный ИИ, нарочно для воздействия на поисковую выдачу. В таком случае окажется, что наблюдения Гриффина кто-то пустит в ход с вредоносными целями. И тогда мы будем всё чаще натыкаться на неточности, и кто-то поверит в искажения из-за недостаточной компьютерной грамотности.

Итак, существует угроза того, что замусоренность интернета измышлениями ИИ может нарастать, поскольку всё больше текстов и прочего контента создаётся с использованием искусственного интеллекта. Так всё актуальнее становится сравнение интернета, в плохом смысле обучающегося на своих ошибках, с ящерицей, кусающей себя за хвост.

- Дмитрий Ладыгин

- bing.com; media.wired.com

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Ельцин не должен был победить: кого Горбачев хотел сделать президентом России?

Почему этот план с самого начала был обречен на поражение?...

Судьба имперских субмарин решена: почему они останутся на дне Крыма навсегда?

Как военные судна вообще оказались затоплены и кто мешал их изучению долгие десятилетия?...

140 стрел и пепел раскрыли тайну гибели самого загадочного города Руси, Гнездово

Город не зачах, не был расселен из-за политических разборок, его уничтожили быстро и жестоко...

Токийская декларация-1993: какую бомбу заложил Ельцин под Россию?

Эксперты говорят: российский президент хотел переиграть Токио, но в итоге дал японцам мощный рычаг воздействия на нашу страну...

Еще одна загадка Ивана Сусанина: что не так с ДНК народного героя?

Почему этот исторический детектив длиной 400 лет никак не могут распутать ученые?...

Почему у самого большого железного метеорита на Земле вообще нет кратера?

Астрофизики говорят: метеорит Хоба в Намибии нарушает все правила природы вот уже 80 000 лет...

Стало известно о 9000-летней строительной технологии, которую почти невозможно повторить даже сейчас

Древним секретом активно интересуются сразу две ведущие промышленные организации в Израиле. Интересно, почему?...

Архив ФСБ раскрыл детали одной из самых дерзких диверсионных операций ВОВ

Биография Кирилла Орловского поражает. Две Звезды Героя, друг писателя Хемингуэя, ликвидатор нацистских палачей, председатель лучшего колхоза СССР...

Удар, который едва не расколол Луну пополам: кратер в 1/10 площади планеты оставил не просто астероид

Столкновение было настолько мощным, что на поверхность выбросило породы с глубины… почти 100 километров!...

Биоинженер провел 100 дней под водой. По его словам, это прибавило ему 10 лет жизни

Почему этот эксперимент вызвал массу критики? Кто победит, официальная теория или опытная практика?...

Правительство США рассекретило почти 200 файлов о неопознанных воздушных явлениях

Американские власти и Пентагон признаются: по большинству фактов нет однозначных решений. Почему?...