Sophia: новый способ обучения больших языковых моделей

Команда из Стэнфордского университета создала новый способ предварительного обучения больших языковых моделей — программное обеспечение под названием Sophia, которое работает вдвое быстрее, чем существующие решения.

ChatGPT и другие приложения, использующие большие языковые модели (LLM), становятся все более популярными и привлекают много внимания со стороны СМИ. На текущий момент крупные технологические компании сильно преобладают над малыми на рынке LLM, и все это связано с дороговизной предварительного обучения языковых моделей. Стоимость может составлять от 10 миллионов долларов, а в некоторых случаях данная сумма увеличивается в десятки и сотни раз. Соответственно, для малых организаций или академических групп большие языковые модели на данный момент практически недоступны

Чтобы решить эту проблему, ученые решили улучшить существующие методы оптимизации LLM. Результатом стала разработка под названием Sophia, которая сокращает время предварительного обучения вдвое.

Чтобы оптимизировать предварительную подготовку LLM, разработчики использовали два метода.

Первый из них, известный как оценка кривизны, уже давно известен, но команда из Стэнфордского университета нашла способ сделать этот подход более эффективным. Суть метода заключается в оптимизации количества шагов, которые требуются для предварительного обучения, а также в правильном распределении нагрузки на каждом из этапов.

Такой шаг кажется очевидным в контексте рассматриваемого процесса, но, как ни странно, от него отказываются большинство компаний, занимающихся разработкой LLM. Дело в том, что оценка кривизны в техническом плане является дорогостоящей и сложной. Обычно оценка производится на каждом шаге оптимизации. Команда из Стэнфордского университета задалась вопросом: а можно ли сделать процесс более эффективным, уменьшив количество обновлений? Разработав оптимизатор Sophia, ученые добились своей цели — кривизна параметров стала оцениваться примерно каждые 10 шагов.

Второй метод команды, называемый отсечением, решает проблему, возникающую при использовании первого — неточную оценку кривизны. При отсечении устанавливается ограничение или пороговое значение для параметров модели. Если параметры превышают этот порог, их сложность считается неприемлемой, и модель не будет обрабатывать их. Таким образом предотвращаются ошибки или проблемы, возникающие из-за сложности, и улучшается эффективность обучения.

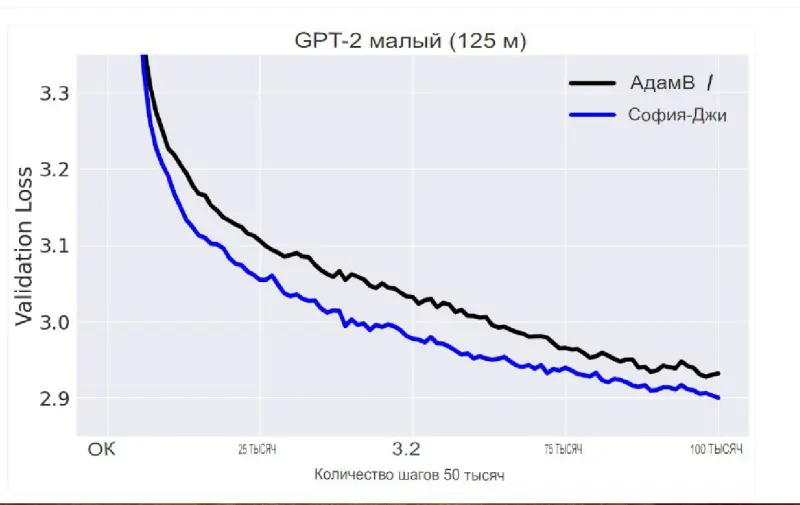

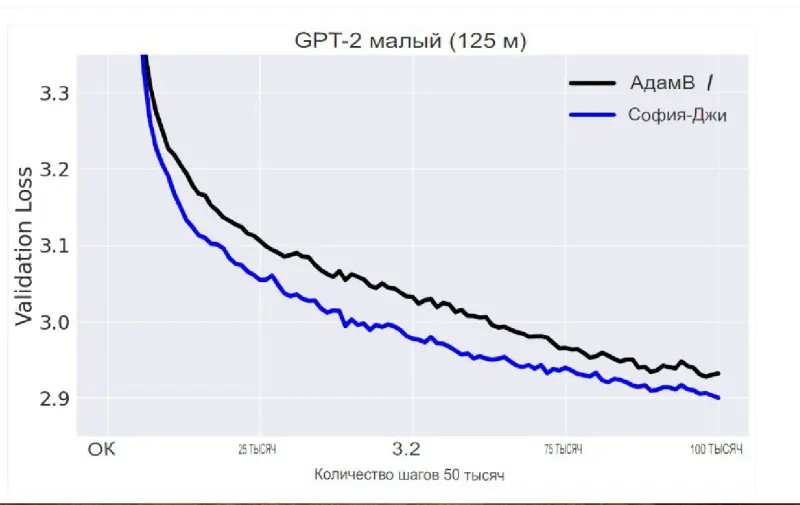

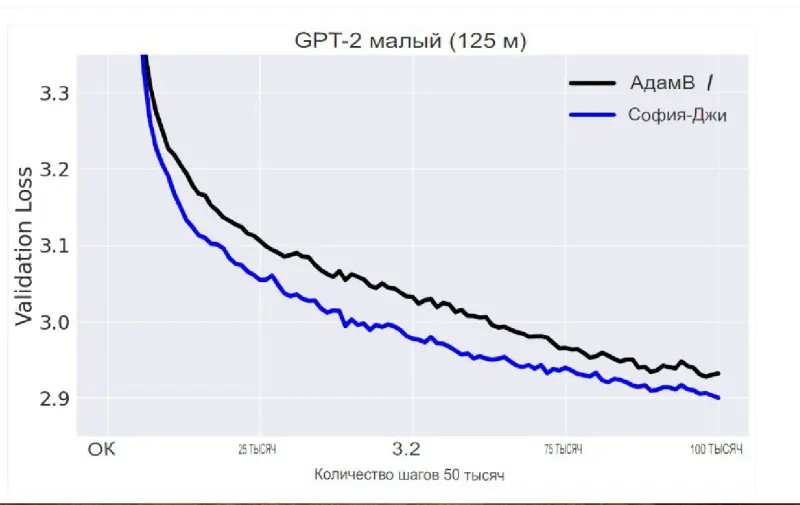

Разработчики использовали Sophia для предварительного обучения относительно небольшой модели LLM, используя те же размеры модели и конфигурацию, которые применялись при создании GPT-2.

В дальнейшем команда планирует разработать более крупную модель LLM с использованием Sophia. Ученые также надеются, что Sophia будет применяться и в других областях машинного обучения, таких как модели компьютерного зрения или мультимодальные модели.

— Гон Лю, аспирант компьютерных наук Стэнфордского университета.

ChatGPT и другие приложения, использующие большие языковые модели (LLM), становятся все более популярными и привлекают много внимания со стороны СМИ. На текущий момент крупные технологические компании сильно преобладают над малыми на рынке LLM, и все это связано с дороговизной предварительного обучения языковых моделей. Стоимость может составлять от 10 миллионов долларов, а в некоторых случаях данная сумма увеличивается в десятки и сотни раз. Соответственно, для малых организаций или академических групп большие языковые модели на данный момент практически недоступны

Чтобы решить эту проблему, ученые решили улучшить существующие методы оптимизации LLM. Результатом стала разработка под названием Sophia, которая сокращает время предварительного обучения вдвое.

Оптимизируя оптимизацию

Чтобы оптимизировать предварительную подготовку LLM, разработчики использовали два метода.

Первый из них, известный как оценка кривизны, уже давно известен, но команда из Стэнфордского университета нашла способ сделать этот подход более эффективным. Суть метода заключается в оптимизации количества шагов, которые требуются для предварительного обучения, а также в правильном распределении нагрузки на каждом из этапов.

Такой шаг кажется очевидным в контексте рассматриваемого процесса, но, как ни странно, от него отказываются большинство компаний, занимающихся разработкой LLM. Дело в том, что оценка кривизны в техническом плане является дорогостоящей и сложной. Обычно оценка производится на каждом шаге оптимизации. Команда из Стэнфордского университета задалась вопросом: а можно ли сделать процесс более эффективным, уменьшив количество обновлений? Разработав оптимизатор Sophia, ученые добились своей цели — кривизна параметров стала оцениваться примерно каждые 10 шагов.

Второй метод команды, называемый отсечением, решает проблему, возникающую при использовании первого — неточную оценку кривизны. При отсечении устанавливается ограничение или пороговое значение для параметров модели. Если параметры превышают этот порог, их сложность считается неприемлемой, и модель не будет обрабатывать их. Таким образом предотвращаются ошибки или проблемы, возникающие из-за сложности, и улучшается эффективность обучения.

Тестирование и масштабирование

Разработчики использовали Sophia для предварительного обучения относительно небольшой модели LLM, используя те же размеры модели и конфигурацию, которые применялись при создании GPT-2.

В дальнейшем команда планирует разработать более крупную модель LLM с использованием Sophia. Ученые также надеются, что Sophia будет применяться и в других областях машинного обучения, таких как модели компьютерного зрения или мультимодальные модели.

Использование Sophia для разработки новой большой языковой модели займет определенное время и достаточно много ресурсов, но так как она является программным обеспечением с открытым исходным кодом, сообщество, безусловно, может брать ее на вооружение

— Гон Лю, аспирант компьютерных наук Стэнфордского университета.

- Алексей Павлов

- arXiv preprint server

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Ельцин не должен был победить: кого Горбачев хотел сделать президентом России?

Почему этот план с самого начала был обречен на поражение?...

Судьба имперских субмарин решена: почему они останутся на дне Крыма навсегда?

Как военные судна вообще оказались затоплены и кто мешал их изучению долгие десятилетия?...

Токийская декларация-1993: какую бомбу заложил Ельцин под Россию?

Эксперты говорят: российский президент хотел переиграть Токио, но в итоге дал японцам мощный рычаг воздействия на нашу страну...

140 стрел и пепел раскрыли тайну гибели самого загадочного города Руси, Гнездово

Город не зачах, не был расселен из-за политических разборок, его уничтожили быстро и жестоко...

Почему у самого большого железного метеорита на Земле вообще нет кратера?

Астрофизики говорят: метеорит Хоба в Намибии нарушает все правила природы вот уже 80 000 лет...

Стало известно о 9000-летней строительной технологии, которую почти невозможно повторить даже сейчас

Древним секретом активно интересуются сразу две ведущие промышленные организации в Израиле. Интересно, почему?...

Архив ФСБ раскрыл детали одной из самых дерзких диверсионных операций ВОВ

Биография Кирилла Орловского поражает. Две Звезды Героя, друг писателя Хемингуэя, ликвидатор нацистских палачей, председатель лучшего колхоза СССР...

Удар, который едва не расколол Луну пополам: кратер в 1/10 площади планеты оставил не просто астероид

Столкновение было настолько мощным, что на поверхность выбросило породы с глубины… почти 100 километров!...

Биоинженер провел 100 дней под водой. По его словам, это прибавило ему 10 лет жизни

Почему этот эксперимент вызвал массу критики? Кто победит, официальная теория или опытная практика?...

Правительство США рассекретило почти 200 файлов о неопознанных воздушных явлениях

Американские власти и Пентагон признаются: по большинству фактов нет однозначных решений. Почему?...

Иран «ставит на счетчик» мировой интернет: сможет ли Тегеран заставить Запад платить за кабели в Ормузе?

Как оказалось, нефть была только началом. Теперь Тегеран берет за горло западную цифровую экономику...

Выяснилось: как британская разведка создала миф о Распутине, чтобы потом его убить

Еще одна история о том, что Англия во всем времена была главным врагом России...