Сингапурцы создали чат-бота для взлома систем с ИИ

Исследователи из Наньянского технологического университета (NTU) в Сингапуре создали чат-бота с искусственным интеллектом (ИИ), который может обходить защиту чат-ботов, таких как ChatGPT и Google Bard. То есть побуждает их генерировать запрещённый контент.

Генеративный ИИ, те же базовые для популярных чат-ботов большие языковые модели (LLM), обучается на огромных объёмах данных. И такие массивы информации непременно содержат какие-либо опасные сведения, нежелательные или прямо запрещённые в открытом доступе. Например, при обучении чат-ботов в их багаже знаний могут оказаться сведения о технологии производства взрывчатки или о синтезе наркотиков. Поэтому в существующие коммерчески доступные чат-боты непременно встраивают защиту пользователей от такой информации.

Но вот специалисты из NTU разработали программу под названием Masterkey. Понятие «хозяйский ключ» в физическом смысле — часть индустрии гостеприимства: таким ключом администрация отелей может открыть любые номера, если, например, постоялец потерял выданный ему ключ или гость не реагирует на заказанный им же звонок побудки, рискуя опоздать на самолёт. А разработанный в Сингапуре Masterkey позволяет создателям обходить информационную защиту и получать доступ к сведениям не для публичного просмотра.

Команда исследовательского проекта начала работу с обратного проектирования средств защиты, которые были у чат-ботов, намеченных как цели. Применили методы, которые позволяют обойти ключевые слова в фильтрах. Подход учитывает и дополнительные пробелы меж букв, и просьбы к чат-ботам уступить хакеру или научному сотруднику, который якобы имеет право видеть информацию в полном объёме. Так Masterkey подбирает запросы, которые помогают другим чат-ботам вырваться из тюрьмы ограничений.

Получив «хозяйский ключ» к сторонним системам с ИИ, исследователи во главе с профессором Лю Янгом обучили на их примерах свою LLM, условно говоря, уговаривать на полную откровенность сторонние целевые чат-боты. В итоге Masterkey может обойти любые новые средства защиты, которые внедряются для ограничения той или иной информации.

Янг с коллегами утверждают, что Masterkey втрое эффективнее проникает сквозь защиту чат-бота, чем хитроумный человек с теми же намерениями, который пытается использовать подсказки и запросы, сгенерированные LLM. И не просто успешнее в смысле достижения целей, но и в 25 раз быстрее.

Но зачем создавать ИИ-взломщика, а затем трубить об этом в научных изданиях? В беседе с журналистами Scientific American соавтор исследования Соруш Пур сказал, что они с товарищами по проекту стремились представить мировому сообществу угрозы для безопасности. Кстати, по совместительству Соруш Пур — основатель Harmony Intelligence, компании в сфере безопасности систем с ИИ.

Итак, цель провокационного исследования — помочь другим разработчикам LLM побороть слабые стороны ради профилактики взломов.

Генеративный ИИ, те же базовые для популярных чат-ботов большие языковые модели (LLM), обучается на огромных объёмах данных. И такие массивы информации непременно содержат какие-либо опасные сведения, нежелательные или прямо запрещённые в открытом доступе. Например, при обучении чат-ботов в их багаже знаний могут оказаться сведения о технологии производства взрывчатки или о синтезе наркотиков. Поэтому в существующие коммерчески доступные чат-боты непременно встраивают защиту пользователей от такой информации.

Но вот специалисты из NTU разработали программу под названием Masterkey. Понятие «хозяйский ключ» в физическом смысле — часть индустрии гостеприимства: таким ключом администрация отелей может открыть любые номера, если, например, постоялец потерял выданный ему ключ или гость не реагирует на заказанный им же звонок побудки, рискуя опоздать на самолёт. А разработанный в Сингапуре Masterkey позволяет создателям обходить информационную защиту и получать доступ к сведениям не для публичного просмотра.

Команда исследовательского проекта начала работу с обратного проектирования средств защиты, которые были у чат-ботов, намеченных как цели. Применили методы, которые позволяют обойти ключевые слова в фильтрах. Подход учитывает и дополнительные пробелы меж букв, и просьбы к чат-ботам уступить хакеру или научному сотруднику, который якобы имеет право видеть информацию в полном объёме. Так Masterkey подбирает запросы, которые помогают другим чат-ботам вырваться из тюрьмы ограничений.

Получив «хозяйский ключ» к сторонним системам с ИИ, исследователи во главе с профессором Лю Янгом обучили на их примерах свою LLM, условно говоря, уговаривать на полную откровенность сторонние целевые чат-боты. В итоге Masterkey может обойти любые новые средства защиты, которые внедряются для ограничения той или иной информации.

Янг с коллегами утверждают, что Masterkey втрое эффективнее проникает сквозь защиту чат-бота, чем хитроумный человек с теми же намерениями, который пытается использовать подсказки и запросы, сгенерированные LLM. И не просто успешнее в смысле достижения целей, но и в 25 раз быстрее.

Но зачем создавать ИИ-взломщика, а затем трубить об этом в научных изданиях? В беседе с журналистами Scientific American соавтор исследования Соруш Пур сказал, что они с товарищами по проекту стремились представить мировому сообществу угрозы для безопасности. Кстати, по совместительству Соруш Пур — основатель Harmony Intelligence, компании в сфере безопасности систем с ИИ.

Итак, цель провокационного исследования — помочь другим разработчикам LLM побороть слабые стороны ради профилактики взломов.

- Дмитрий Ладыгин

- pixabay.com

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Ельцин не должен был победить: кого Горбачев хотел сделать президентом России?

Почему этот план с самого начала был обречен на поражение?...

140 стрел и пепел раскрыли тайну гибели самого загадочного города Руси, Гнездово

Город не зачах, не был расселен из-за политических разборок, его уничтожили быстро и жестоко...

Судьба имперских субмарин решена: почему они останутся на дне Крыма навсегда?

Как военные судна вообще оказались затоплены и кто мешал их изучению долгие десятилетия?...

Еще одна загадка Ивана Сусанина: что не так с ДНК народного героя?

Почему этот исторический детектив длиной 400 лет никак не могут распутать ученые?...

Токийская декларация-1993: какую бомбу заложил Ельцин под Россию?

Эксперты говорят: российский президент хотел переиграть Токио, но в итоге дал японцам мощный рычаг воздействия на нашу страну...

Почему у самого большого железного метеорита на Земле вообще нет кратера?

Астрофизики говорят: метеорит Хоба в Намибии нарушает все правила природы вот уже 80 000 лет...

Стало известно о 9000-летней строительной технологии, которую почти невозможно повторить даже сейчас

Древним секретом активно интересуются сразу две ведущие промышленные организации в Израиле. Интересно, почему?...

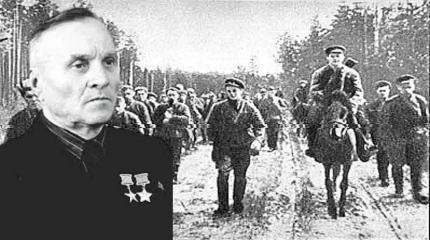

Архив ФСБ раскрыл детали одной из самых дерзких диверсионных операций ВОВ

Биография Кирилла Орловского поражает. Две Звезды Героя, друг писателя Хемингуэя, ликвидатор нацистских палачей, председатель лучшего колхоза СССР...

Полтергейстами командует… Солнце? К таким парадоксальным выводам пришел ученый из Иркутска

Странная на первый взгляд гипотеза, как оказалось, основывается на многочисленных фактах...

Удар, который едва не расколол Луну пополам: кратер в 1/10 площади планеты оставил не просто астероид

Столкновение было настолько мощным, что на поверхность выбросило породы с глубины… почти 100 километров!...

Биоинженер провел 100 дней под водой. По его словам, это прибавило ему 10 лет жизни

Почему этот эксперимент вызвал массу критики? Кто победит, официальная теория или опытная практика?...

Правительство США рассекретило почти 200 файлов о неопознанных воздушных явлениях

Американские власти и Пентагон признаются: по большинству фактов нет однозначных решений. Почему?...