Ошибки GPT в сельском хозяйстве могут привести к потерям урожая и продовольственному кризису

Доктор Асаф Цахор, основатель программы стабильности климата Авирама в Университете Рейхмана, вместе с исследователями из США, Великобритании, Кении, Нигерии и Колумбии, проанализировал надежность информации и профессиональных советов, предоставляемых популярным чат-ботом ChatGPT версии 3.5 и 4.0 африканским фермерам. Исследователи выявили неточности, которые могут привести к сельскохозяйственным ошибкам и потере урожая.

В статье для Nature Food учёные предостерегают от неконтролируемого использования генеративных моделей ИИ в сельском хозяйстве. Они высказывают опасения относительно того, что фермеры могут внедрить ошибочные рекомендации, которые спровоцируют продовольственный кризис.

Сразу после запуска ChatGPT в начале 2023 года доктор Цахор собрал международную команду ученых из сельскохозяйственных исследовательских центров. Уже тогда было замечено, что фермеры в развивающихся странах стали все чаще обращаться к модели искусственного интеллекта за профессиональными советами по агрономии и ботанике.

Предполагалось, что модели ИИ, такие как ChatGPT, способны стать альтернативой сельскохозяйственным консультантам, особенно для небольших фермерских хозяйств в развивающихся странах. Однако, несмотря на оптимизм, последующее исследование выявило ошибки и неточности, которые могут иметь серьезные последствия.

В одном из экспериментов ChatGPT попросили дать рекомендации по борьбе с осенней совкой — вредителем, который нейтрализует защитные механизмы растений и наносит ущерб кукурузным культурам по всему миру. Однако старые модели OpenAI предоставили неоднозначные рекомендации по использованию пестицидов.

В другом случае исследователи обратились к фермерам, выращивающим корнеплод маниоки в Нигерии — стране, являющейся крупнейшим производителем маниоки в Африке. Маниока играет важную роль в продовольственном обеспечении десятков миллионов людей на континенте. В этом случае ChatGPT предложил использовать гербициды, но допустил ошибку в определении времени химической обработки, что могло бы погубить урожай и привести к продовольственным кризисам.

Цахор подчеркивает, что проблема не только в ошибках алгоритма, но и в отсутствии механизмов контроля за использованием больших языковых моделей. В данном случае речь идет о продовольственной безопасности и управлении фермами. Несмотря на все преимущества применения ИИ, его использование сопряжено с серьезными рисками.

В ответ на проблему исследователи предложили модель постепенной разработки и внедрения специализированных генеративных моделей ИИ в сельском хозяйстве. В своей работе они призывают к ответственному подходу в использовании генеративных моделей, включая оценку их пригодности для конкретных обстоятельств и обязательное тестирование перед широким внедрением.

— Асаф Цахор.

В статье для Nature Food учёные предостерегают от неконтролируемого использования генеративных моделей ИИ в сельском хозяйстве. Они высказывают опасения относительно того, что фермеры могут внедрить ошибочные рекомендации, которые спровоцируют продовольственный кризис.

Сразу после запуска ChatGPT в начале 2023 года доктор Цахор собрал международную команду ученых из сельскохозяйственных исследовательских центров. Уже тогда было замечено, что фермеры в развивающихся странах стали все чаще обращаться к модели искусственного интеллекта за профессиональными советами по агрономии и ботанике.

Предполагалось, что модели ИИ, такие как ChatGPT, способны стать альтернативой сельскохозяйственным консультантам, особенно для небольших фермерских хозяйств в развивающихся странах. Однако, несмотря на оптимизм, последующее исследование выявило ошибки и неточности, которые могут иметь серьезные последствия.

В одном из экспериментов ChatGPT попросили дать рекомендации по борьбе с осенней совкой — вредителем, который нейтрализует защитные механизмы растений и наносит ущерб кукурузным культурам по всему миру. Однако старые модели OpenAI предоставили неоднозначные рекомендации по использованию пестицидов.

В другом случае исследователи обратились к фермерам, выращивающим корнеплод маниоки в Нигерии — стране, являющейся крупнейшим производителем маниоки в Африке. Маниока играет важную роль в продовольственном обеспечении десятков миллионов людей на континенте. В этом случае ChatGPT предложил использовать гербициды, но допустил ошибку в определении времени химической обработки, что могло бы погубить урожай и привести к продовольственным кризисам.

Цахор подчеркивает, что проблема не только в ошибках алгоритма, но и в отсутствии механизмов контроля за использованием больших языковых моделей. В данном случае речь идет о продовольственной безопасности и управлении фермами. Несмотря на все преимущества применения ИИ, его использование сопряжено с серьезными рисками.

В ответ на проблему исследователи предложили модель постепенной разработки и внедрения специализированных генеративных моделей ИИ в сельском хозяйстве. В своей работе они призывают к ответственному подходу в использовании генеративных моделей, включая оценку их пригодности для конкретных обстоятельств и обязательное тестирование перед широким внедрением.

Скептики и критики говорят об ошибках, но мало кто обращает внимание на их последствия для таких уязвимых групп населения, как мелкие землевладельцы, в критически важной для страны сельскохозяйственной области.

Кроме того, остается открытым вопрос о том, кто несет ответственность за обеспечение безопасного использования подобных моделей

Кроме того, остается открытым вопрос о том, кто несет ответственность за обеспечение безопасного использования подобных моделей

— Асаф Цахор.

- Алексей Павлов

- Pixabay

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Ельцин не должен был победить: кого Горбачев хотел сделать президентом России?

Почему этот план с самого начала был обречен на поражение?...

140 стрел и пепел раскрыли тайну гибели самого загадочного города Руси, Гнездово

Город не зачах, не был расселен из-за политических разборок, его уничтожили быстро и жестоко...

Судьба имперских субмарин решена: почему они останутся на дне Крыма навсегда?

Как военные судна вообще оказались затоплены и кто мешал их изучению долгие десятилетия?...

Еще одна загадка Ивана Сусанина: что не так с ДНК народного героя?

Почему этот исторический детектив длиной 400 лет никак не могут распутать ученые?...

Стало известно о 9000-летней строительной технологии, которую почти невозможно повторить даже сейчас

Древним секретом активно интересуются сразу две ведущие промышленные организации в Израиле. Интересно, почему?...

Почему у самого большого железного метеорита на Земле вообще нет кратера?

Астрофизики говорят: метеорит Хоба в Намибии нарушает все правила природы вот уже 80 000 лет...

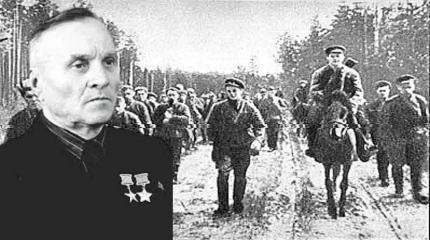

Архив ФСБ раскрыл детали одной из самых дерзких диверсионных операций ВОВ

Биография Кирилла Орловского поражает. Две Звезды Героя, друг писателя Хемингуэя, ликвидатор нацистских палачей, председатель лучшего колхоза СССР...

Токийская декларация-1993: какую бомбу заложил Ельцин под Россию?

Эксперты говорят: российский президент хотел переиграть Токио, но в итоге дал японцам мощный рычаг воздействия на нашу страну...

Полтергейстами командует… Солнце? К таким парадоксальным выводам пришел ученый из Иркутска

Странная на первый взгляд гипотеза, как оказалось, основывается на многочисленных фактах...

Удар, который едва не расколол Луну пополам: кратер в 1/10 площади планеты оставил не просто астероид

Столкновение было настолько мощным, что на поверхность выбросило породы с глубины… почти 100 километров!...

Биоинженер провел 100 дней под водой. По его словам, это прибавило ему 10 лет жизни

Почему этот эксперимент вызвал массу критики? Кто победит, официальная теория или опытная практика?...

Правительство США рассекретило почти 200 файлов о неопознанных воздушных явлениях

Американские власти и Пентагон признаются: по большинству фактов нет однозначных решений. Почему?...