Как победить ложь в интернете: новая функция Google «Об этом изображении»

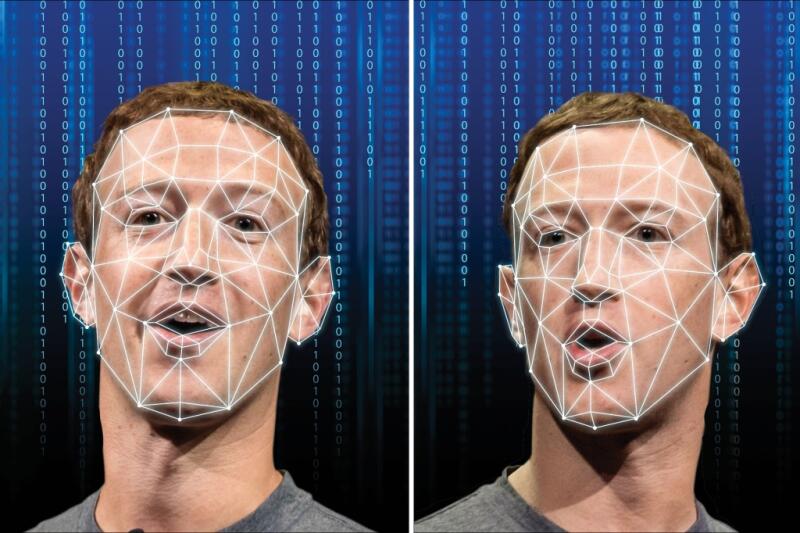

В современном интернете мы часто сталкиваемся с поддельными изображениями, которые могут обманывать нас или даже наносить вред. Особенно опасны дипфейки — это видео или фото, созданные с помощью искусственного интеллекта, которые подменяют лица, голоса или действия людей. Дипфейки могут влиять на наше мнение, эмоции и поведение, а также использоваться для целей дезинформации, шантажа, порнографии или политики.

Как же защитить себя от таких угроз? Компания Google разработала новую функцию «Об этом изображении», которая позволяет пользователям получать больше информации об изображениях, которые они видят в интернете. В этой статье мы расскажем, как эта функция работает, как она помогает распознавать дипфейки и какие еще технологии используются для борьбы с цифровой манипуляцией.

Дипфейки — это видео или фото, которые создаются с помощью искусственного интеллекта. Для этого используются специальные алгоритмы, которые называются генеративно-состязательными сетями (GAN). Эти сети состоят из двух нейронных сетей, которые соревнуются друг с другом: одна сеть генерирует поддельное изображение, а другая сеть пытается определить, насколько оно реалистично. Таким образом, сети постоянно учатся и улучшают свои результаты.

Дипфейки бывают разных видов: например, можно поменять лица людей на видео (face swap), изменить то, что они говорят (lip sync), скопировать их голос (voice cloning) или создать полностью синтетические лица и тела (digital avatars). С помощью дипфейков можно также «оживить» умерших людей или животных, как это было сделано с художником Сальвадором Дали или кошкой Лил Баб.

Дипфейки могут быть использованы не только для развлечения или искусства, но и для злых целей. В том числе для распространения дезинформации, шантажа, порнографии или политического вмешательства. Дипфейки могут заставить нас верить, что кто-то говорит или делает то, что он на самом деле не говорил или не делал.

Например, в ходе конфликта между Россией и Украиной в интернете появились дипфейки с президентами обеих стран, которые призывали своих солдат сдаться. Эти дипфейки были распространены через социальные сети и даже взломанные телеканалы. Хотя видеоролики были быстро опровергнуты и раскритикованы за низкое качество, они могли вызвать путаницу, недоверие и страх среди населения.

Другой пример — это дипфейк с бывшим президентом США Бараком Обамой, который якобы оскорблял своего преемника Дональда Трампа. Видео было создано известным комиком Джорданом Пилом и показано в телешоу. Хотя это был юмористический ролик, он также продемонстрировал потенциал дипфейков для подделки политических высказываний и компрометации лидеров.

Однако не все поддельные видео имеют юмористический или политический характер. Еще один пример — это поддельное видео с актрисой Галь Гадот, которая якобы снималась в порнофильме. Это видео было создано с помощью программы DeepFaceLab и размещено на сайте Pornhub. Хотя видео было удалено после жалоб, оно также показало возможность дипфейк-технологий.

Как видим, дипфейки могут нести разные опасности для общества и индивидов. Поэтому необходимо развивать критическое мышление, проверять информацию из разных источников и использовать специальные инструменты для обнаружения дипфейков. Также нужно разрабатывать законодательство и этические нормы для регулирования создания и распространения дипфейков.

Функция «Об этом изображении» позволит пользователям проверять достоверность и происхождение изображений, которые могут быть использованы для обмана или дезинформации.

В блоге Google объясняют, что эта функция предоставит три вида информации об изображениях в результатах поиска. Во-первых, она покажет, когда Google впервые проиндексировал изображение. Во-вторых, она укажет, где изображение было опубликовано в интернете впервые. В-третьих, она покажет, где изображение появлялось в других источниках, например, в социальных сетях, новостных сайтах или сайтах по проверке фактов.

— Google.

Поисковый гигант также добавил, что когда он запустит свои собственные генеративные инструменты искусственного интеллекта для создания изображений, они получат специальную разметку на случай распространения на других сайтах.

Как же защитить себя от таких угроз? Компания Google разработала новую функцию «Об этом изображении», которая позволяет пользователям получать больше информации об изображениях, которые они видят в интернете. В этой статье мы расскажем, как эта функция работает, как она помогает распознавать дипфейки и какие еще технологии используются для борьбы с цифровой манипуляцией.

Что такое дипфейки и как их создают?

Дипфейки — это видео или фото, которые создаются с помощью искусственного интеллекта. Для этого используются специальные алгоритмы, которые называются генеративно-состязательными сетями (GAN). Эти сети состоят из двух нейронных сетей, которые соревнуются друг с другом: одна сеть генерирует поддельное изображение, а другая сеть пытается определить, насколько оно реалистично. Таким образом, сети постоянно учатся и улучшают свои результаты.

Дипфейки бывают разных видов: например, можно поменять лица людей на видео (face swap), изменить то, что они говорят (lip sync), скопировать их голос (voice cloning) или создать полностью синтетические лица и тела (digital avatars). С помощью дипфейков можно также «оживить» умерших людей или животных, как это было сделано с художником Сальвадором Дали или кошкой Лил Баб.

Какие опасности несут дипфейки?

Дипфейки могут быть использованы не только для развлечения или искусства, но и для злых целей. В том числе для распространения дезинформации, шантажа, порнографии или политического вмешательства. Дипфейки могут заставить нас верить, что кто-то говорит или делает то, что он на самом деле не говорил или не делал.

Например, в ходе конфликта между Россией и Украиной в интернете появились дипфейки с президентами обеих стран, которые призывали своих солдат сдаться. Эти дипфейки были распространены через социальные сети и даже взломанные телеканалы. Хотя видеоролики были быстро опровергнуты и раскритикованы за низкое качество, они могли вызвать путаницу, недоверие и страх среди населения.

Другой пример — это дипфейк с бывшим президентом США Бараком Обамой, который якобы оскорблял своего преемника Дональда Трампа. Видео было создано известным комиком Джорданом Пилом и показано в телешоу. Хотя это был юмористический ролик, он также продемонстрировал потенциал дипфейков для подделки политических высказываний и компрометации лидеров.

Однако не все поддельные видео имеют юмористический или политический характер. Еще один пример — это поддельное видео с актрисой Галь Гадот, которая якобы снималась в порнофильме. Это видео было создано с помощью программы DeepFaceLab и размещено на сайте Pornhub. Хотя видео было удалено после жалоб, оно также показало возможность дипфейк-технологий.

Как видим, дипфейки могут нести разные опасности для общества и индивидов. Поэтому необходимо развивать критическое мышление, проверять информацию из разных источников и использовать специальные инструменты для обнаружения дипфейков. Также нужно разрабатывать законодательство и этические нормы для регулирования создания и распространения дипфейков.

Как новая функция Google поможет бороться с манипуляциями и ложью в интернете?

Функция «Об этом изображении» позволит пользователям проверять достоверность и происхождение изображений, которые могут быть использованы для обмана или дезинформации.

В блоге Google объясняют, что эта функция предоставит три вида информации об изображениях в результатах поиска. Во-первых, она покажет, когда Google впервые проиндексировал изображение. Во-вторых, она укажет, где изображение было опубликовано в интернете впервые. В-третьих, она покажет, где изображение появлялось в других источниках, например, в социальных сетях, новостных сайтах или сайтах по проверке фактов.

С этой дополнительной информацией об изображении вы сможете лучше оценить его надежность — или решить, что нужно провести дополнительную проверку. Например, с помощью «Об этом изображении» вы сможете узнать, что в новостных статьях сообщалось, что это изображение, демонстрирующее посадку на Луну поэтапно, было сгенерировано ИИ

— Google.

Поисковый гигант также добавил, что когда он запустит свои собственные генеративные инструменты искусственного интеллекта для создания изображений, они получат специальную разметку на случай распространения на других сайтах.

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Ельцин не должен был победить: кого Горбачев хотел сделать президентом России?

Почему этот план с самого начала был обречен на поражение?...

Токийская декларация-1993: какую бомбу заложил Ельцин под Россию?

Эксперты говорят: российский президент хотел переиграть Токио, но в итоге дал японцам мощный рычаг воздействия на нашу страну...

Судьба имперских субмарин решена: почему они останутся на дне Крыма навсегда?

Как военные судна вообще оказались затоплены и кто мешал их изучению долгие десятилетия?...

140 стрел и пепел раскрыли тайну гибели самого загадочного города Руси, Гнездово

Город не зачах, не был расселен из-за политических разборок, его уничтожили быстро и жестоко...

Почему у самого большого железного метеорита на Земле вообще нет кратера?

Астрофизики говорят: метеорит Хоба в Намибии нарушает все правила природы вот уже 80 000 лет...

Стало известно о 9000-летней строительной технологии, которую почти невозможно повторить даже сейчас

Древним секретом активно интересуются сразу две ведущие промышленные организации в Израиле. Интересно, почему?...

Архив ФСБ раскрыл детали одной из самых дерзких диверсионных операций ВОВ

Биография Кирилла Орловского поражает. Две Звезды Героя, друг писателя Хемингуэя, ликвидатор нацистских палачей, председатель лучшего колхоза СССР...

Удар, который едва не расколол Луну пополам: кратер в 1/10 площади планеты оставил не просто астероид

Столкновение было настолько мощным, что на поверхность выбросило породы с глубины… почти 100 километров!...

Биоинженер провел 100 дней под водой. По его словам, это прибавило ему 10 лет жизни

Почему этот эксперимент вызвал массу критики? Кто победит, официальная теория или опытная практика?...

Правительство США рассекретило почти 200 файлов о неопознанных воздушных явлениях

Американские власти и Пентагон признаются: по большинству фактов нет однозначных решений. Почему?...

Выяснилось: как британская разведка создала миф о Распутине, чтобы потом его убить

Еще одна история о том, что Англия во всем времена была главным врагом России...

Иран «ставит на счетчик» мировой интернет: сможет ли Тегеран заставить Запад платить за кабели в Ормузе?

Как оказалось, нефть была только началом. Теперь Тегеран берет за горло западную цифровую экономику...