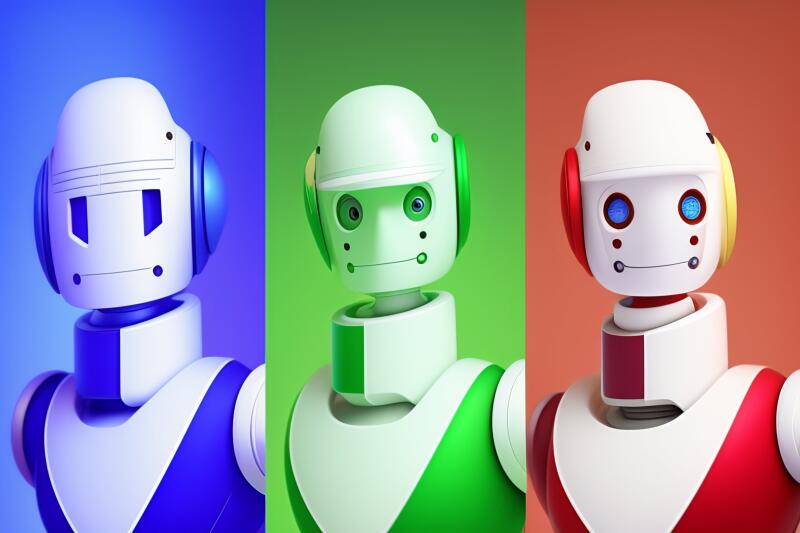

Чат Bing на базе искусственного интеллекта приобрел три «характера»

Сотрудник Microsoft Майк Дэвидсон объявил, что компания представила три отличительных стиля личности для своего экспериментального чат-бота Bing на базе искусственного интеллекта (ИИ): творческий, сбалансированный и точный. Microsoft тестирует эту функцию с 24 февраля на ограниченном круге пользователей. Переключение между режимами даёт разные результаты, которые меняют баланс между точностью и творческой составляющей, да, той самой креативностью.

Bing Chat — это помощник с поддержкой ИИ, основанный на усовершенствованной модели большого языка (LLM), разработанной компанией OpenAI. Ключевая особенность Bing Chat — способность выполнить поиск в интернете и включать результаты в свои ответы.

Microsoft анонсировала Bing Chat 7 февраля, и вскоре враждебные запросы регулярно приводили раннюю версию Bing Chat к симуляции безумия. Так пользователи обнаружили, что бота можно убедить угрожать им. Вскоре после этого Microsoft резко сократила всплески поведения Bing Chat, установив строгие ограничения на продолжительность разговоров.

С тех пор фирма экспериментирует со способами вернуть часть дерзкой индивидуальности Bing Chat для тех, кто этого хотел, но также позволяет другим пользователям искать более точные ответы. Это привело к появлению нового интерфейса «стиль разговора» с тремя вариантами выбора.

В экспериментах с тремя стилями журналисты издания ArsTechnica заметили, что «креативный» режим выдаёт более короткие и нестандартные предложения, которые не всегда безопасны или практичны. Точный режим допускал ошибки в сторону осторожности, иногда ничего не предлагая, если не видел безопасного способа достижения результата. В среднем режиме, сбалансированном, часто выдавались самые длинные ответы с самыми подробными результатами поиска и ссылками на веб-сайты в ответах.

С большими языковыми моделями неожиданные неточности (так называемые галлюцинации) часто учащаются с увеличением «креативности», что обычно означает, что модель ИИ будет больше отклоняться от информации, которую она изучила в своём наборе данных. Исследователи ИИ часто называют это свойство «температурой», но члены команды Bing говорят, что с новыми стилями общения происходит нечто большее.

По словам сотрудника Microsoft Михаила Парахина, переключение режимов в Bing Chat меняет фундаментальные аспекты поведения бота, в том числе переключение между различными моделями ИИ, которые прошли дополнительное обучение на основе человеческих ответов на его результаты. В разных режимах также используются разные начальные подсказки, а это означает, что Microsoft заменяет определяющую личность подсказку.

Хотя Bing Chat по-прежнему доступен только тем, кто зарегистрировался в списке ожидания, Microsoft продолжает совершенствовать его и другие функции поиска Bing на базе ИИ, готовясь к более широкому распространению среди пользователей. Недавно Microsoft объявила о планах по интеграции технологии в Windows 11.

Bing Chat — это помощник с поддержкой ИИ, основанный на усовершенствованной модели большого языка (LLM), разработанной компанией OpenAI. Ключевая особенность Bing Chat — способность выполнить поиск в интернете и включать результаты в свои ответы.

Microsoft анонсировала Bing Chat 7 февраля, и вскоре враждебные запросы регулярно приводили раннюю версию Bing Chat к симуляции безумия. Так пользователи обнаружили, что бота можно убедить угрожать им. Вскоре после этого Microsoft резко сократила всплески поведения Bing Chat, установив строгие ограничения на продолжительность разговоров.

С тех пор фирма экспериментирует со способами вернуть часть дерзкой индивидуальности Bing Chat для тех, кто этого хотел, но также позволяет другим пользователям искать более точные ответы. Это привело к появлению нового интерфейса «стиль разговора» с тремя вариантами выбора.

В экспериментах с тремя стилями журналисты издания ArsTechnica заметили, что «креативный» режим выдаёт более короткие и нестандартные предложения, которые не всегда безопасны или практичны. Точный режим допускал ошибки в сторону осторожности, иногда ничего не предлагая, если не видел безопасного способа достижения результата. В среднем режиме, сбалансированном, часто выдавались самые длинные ответы с самыми подробными результатами поиска и ссылками на веб-сайты в ответах.

С большими языковыми моделями неожиданные неточности (так называемые галлюцинации) часто учащаются с увеличением «креативности», что обычно означает, что модель ИИ будет больше отклоняться от информации, которую она изучила в своём наборе данных. Исследователи ИИ часто называют это свойство «температурой», но члены команды Bing говорят, что с новыми стилями общения происходит нечто большее.

По словам сотрудника Microsoft Михаила Парахина, переключение режимов в Bing Chat меняет фундаментальные аспекты поведения бота, в том числе переключение между различными моделями ИИ, которые прошли дополнительное обучение на основе человеческих ответов на его результаты. В разных режимах также используются разные начальные подсказки, а это означает, что Microsoft заменяет определяющую личность подсказку.

Хотя Bing Chat по-прежнему доступен только тем, кто зарегистрировался в списке ожидания, Microsoft продолжает совершенствовать его и другие функции поиска Bing на базе ИИ, готовясь к более широкому распространению среди пользователей. Недавно Microsoft объявила о планах по интеграции технологии в Windows 11.

- Дмитрий Ладыгин

- lexica.art

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Анализ ДНК с Туринской плащаницы сильно удивил ученых, точнее, даже озадачил

Эксперты говорят: выделить «геном Христа» вряд ли получится. И вообще, этот артефакт никогда не был в Святой Земле. Как же так?...

Астронавт NASA внезапно потерял способность говорить в космосе, и врачи не знают почему

Эксперты говорят: инцидент на орбите может сильно не только космическую медицину, но вообще полеты на Луну и Марс...

ФСБ рассекретила документы по процессу 1950 года: за что судили немецких военных?

Почему информация 75 лет находилась под грифом «Совершенно секретно», а День Победы не праздновали до 1965 года?...

Припрятал сокровища, но был убит: историки раскрыли трагическую судьбу владельца богатейшего клада Москвы

Почему наследники так и не нашли это огромное состояние, хотя ходили по нему каждый день?...

Советские МиГи… на самой секретной базе США: эта история стала публичной только в 2000-х годах

Эксперт рассказал, что делали самолеты из СССР в «Зоне-51» и почему американские военные зауважали русских конструкторов...

ЦРУ массово создавало зомби-убийц: новое расследование подтвердило это еще раз

Эксперт уверен: убийца Кеннеди и самый известный американский маньяк — это продукты тогдашних экспериментов над сознанием...

Тайна 12 000-летнего города у берегов США: ученый-любитель уверен, что нашел затонувший мегаполис неизвестной цивилизации

Кто победит: официальная наука или энтузиазм непрофессионала? Разбираемся в этой запутанной истории...

Страшнее Хиросимы и Нагасаки: как американская авиация превратила Японию в одни сплошные пылающие руины

Токио от зажигательных бомб горел так сильно, что люди, прятавшиеся в каналах и прудах, варились заживо...

Тайну «проклятия фараонов» раскрыло письмо столетней давности

Открыватель гробницы Тутанхамона, археолог Говард Картер, прямо называл имя человека, который изобрел «сенсацию». В итоге потрясающее научное открытие...

Пчелы стремительно исчезают в России: из-за чего так происходит и чем это грозит россиянам?

Почему ученые считают, что государство самоустранилось от решения данной проблемы?...