Fauxtomation: как за фасадом ИИ скрываются «рабы» с цифровых «плантаций»

В эпоху, когда искусственный интеллект стал символом технологического прорыва, стартапы все чаще используют его как магическое заклинание для привлечения миллионов долларов. Но за громкими заявлениями о «революционных алгоритмах» нередко скрывается старая добрая рутина — низкооплачиваемые работники, вручную выполняющие задачи, которые должны были быть автоматизированы.

История компании Nate, обвиненной в мошенничестве, — лишь верхушка айсберга. От Нью-Йорка до Манилы, от Калифорнии до Найроби, за фасадом «инноваций» кипит скрытый человеческий труд, а инвесторы теряют миллионы, веря в мираж.

В 2018 году Альберт Санигер основал Nate — стартап, который обещал перевернуть мир электронной коммерции. Приложение, по словам его создателя, позволяло совершать покупки на любом сайте «одним щелчком» благодаря «уникальному ИИ».

Секрет ИИ оказался крайне прост

Эта идея оказалась настолько привлекательной, что к 2021 году Nate привлек 50 млн $ от топ-инвесторов: Coatue, Forerunner Ventures и Renegade Partners. В пресс-релизах Санигер подчеркивал, что система работает «без участия человека», за исключением «крайних случаев».

Однако в 2022 году расследование The Information вскрыло неприглядную правду: вместо алгоритмов компания использовала сотни сотрудников колл-центров на Филиппинах, которые вручную оформляли заказы. Как заявило Министерство юстиции США, «фактическая степень автоматизации составляла 0%». Инвесторы, поверившие в «прорывную технологию», потеряли почти все: к январю 2023 года Nate обанкротилась и продала активы. Санигер, который теперь числится управляющим партнером Buttercore Partners, отказался комментировать ситуацию.

Этот случай — не просто провал стартапа. Это системный обман, где ИИ стал ширмой для прикрытия архаичных методов. Как отметили в американском суде, Санигер сознательно вводил инвесторов в заблуждение, утверждая, что компания «приобрела технологии ИИ и наняла специалистов». На деле же расходы ушли на оплату труда тысяч «невидимых» работников, чьи руки заменяли код.

В современном IT-словаре уже появился термин fauxtomation. Он означает создание иллюзии автоматизации через скрытый человеческий труд. Nate, кстати, далеко не единственный пример, когда в погоне за инвестициями и хайпом, компании имитировали ИИ, маскируя под ним живых людей.

Amazon Just Walk Out — система бесконтактной оплаты в магазинах Amazon — рекламировалась как чудо компьютерного зрения. Однако Bloomberg выяснил, что 70% транзакций проверяли более 1000 индийских работников, просматривавших записи с камер. Компания оправдывалась «обучением ИИ», но, как отметил Scientific American, «основную работу выполняли люди».

Куча индусов, и нейросеть готова!

Receipt Bank (Dext), стартап, обещавший «ИИ для оцифровки чеков», до 2020 года использовал филиппинские команды для ручного ввода данных в Excel. Этот подход, названный Concierge MVP, позволял собирать данные для будущих алгоритмов, но текущие клиенты даже не догадывались, что платят за «человеческий ИИ».

X.ai — сервис планирования встреч через email заявлял о «полностью автономном ИИ», но 90% писем обрабатывали люди. Лишь после накопления данных стартап начал внедрять алгоритмы, сохраняя человеческий контроль за сложными кейсами.

EEB (FTC, 2024) — компания, обещавшая клиентам «ИИ для создания миллионных бизнесов», использовала низкооплачиваемых работников для ручного управления магазинами. FTC признала их заявления фиктивными, а прибыль — результатом эксплуатации труда.

Scale AI — партнер OpenAI и Meta нанимал тысячи кенийских и филиппинских работников за 1-2 $ в час для маркировки данных. Несмотря на лозунги о «революции», 40% задач требовали ручной проверки. Time назвал это «цифровыми потогонками».

Крах Nate и подобных компаний ставит острые вопросы. Почему инвесторы, вкладывающие миллионы, не проверяют реальные процессы? Как регулировать заявления о ИИ, которые оказались пустыми обещаниями? И главное, что делать с «невидимой» рабочей силой, трудящейся в тени алгоритмов?

Эксперты говорят, что фейковые ИИ будут множиться

С одной стороны, стартапы оправдываются: ручной труд — временная мера для обучения ИИ. Но, как показывает пример Nate, переход к автоматизации так и не происходит. Более того, работники из стран с низкими зарплатами становятся заложниками системы. Scale AI платил кенийцам 1,5 $ в час за модерацию контента, включая травмирующие материалы.

С другой — инвесторы слишком легко ведутся на хайп. Венчурные фонды хотят верить в сказку об ИИ, даже если для этого нужно закрыть глаза на реальность. Власти в разных странах начинают бороться с этим обманом, но пока судебных дел — единицы.

Также остается открытым и вопрос регулирования. Должны ли компании раскрывать долю человеческого труда в своих «ИИ-продуктах»? Как предотвратить эксплуатацию в глобальном масштабе? Пока ответов нет.

История компании Nate, обвиненной в мошенничестве, — лишь верхушка айсберга. От Нью-Йорка до Манилы, от Калифорнии до Найроби, за фасадом «инноваций» кипит скрытый человеческий труд, а инвесторы теряют миллионы, веря в мираж.

Нейросеть по-филиппински

В 2018 году Альберт Санигер основал Nate — стартап, который обещал перевернуть мир электронной коммерции. Приложение, по словам его создателя, позволяло совершать покупки на любом сайте «одним щелчком» благодаря «уникальному ИИ».

Секрет ИИ оказался крайне прост

Эта идея оказалась настолько привлекательной, что к 2021 году Nate привлек 50 млн $ от топ-инвесторов: Coatue, Forerunner Ventures и Renegade Partners. В пресс-релизах Санигер подчеркивал, что система работает «без участия человека», за исключением «крайних случаев».

Однако в 2022 году расследование The Information вскрыло неприглядную правду: вместо алгоритмов компания использовала сотни сотрудников колл-центров на Филиппинах, которые вручную оформляли заказы. Как заявило Министерство юстиции США, «фактическая степень автоматизации составляла 0%». Инвесторы, поверившие в «прорывную технологию», потеряли почти все: к январю 2023 года Nate обанкротилась и продала активы. Санигер, который теперь числится управляющим партнером Buttercore Partners, отказался комментировать ситуацию.

Этот случай — не просто провал стартапа. Это системный обман, где ИИ стал ширмой для прикрытия архаичных методов. Как отметили в американском суде, Санигер сознательно вводил инвесторов в заблуждение, утверждая, что компания «приобрела технологии ИИ и наняла специалистов». На деле же расходы ушли на оплату труда тысяч «невидимых» работников, чьи руки заменяли код.

Fauxtomation — фейковые ИИ

В современном IT-словаре уже появился термин fauxtomation. Он означает создание иллюзии автоматизации через скрытый человеческий труд. Nate, кстати, далеко не единственный пример, когда в погоне за инвестициями и хайпом, компании имитировали ИИ, маскируя под ним живых людей.

Amazon Just Walk Out — система бесконтактной оплаты в магазинах Amazon — рекламировалась как чудо компьютерного зрения. Однако Bloomberg выяснил, что 70% транзакций проверяли более 1000 индийских работников, просматривавших записи с камер. Компания оправдывалась «обучением ИИ», но, как отметил Scientific American, «основную работу выполняли люди».

Куча индусов, и нейросеть готова!

Receipt Bank (Dext), стартап, обещавший «ИИ для оцифровки чеков», до 2020 года использовал филиппинские команды для ручного ввода данных в Excel. Этот подход, названный Concierge MVP, позволял собирать данные для будущих алгоритмов, но текущие клиенты даже не догадывались, что платят за «человеческий ИИ».

X.ai — сервис планирования встреч через email заявлял о «полностью автономном ИИ», но 90% писем обрабатывали люди. Лишь после накопления данных стартап начал внедрять алгоритмы, сохраняя человеческий контроль за сложными кейсами.

EEB (FTC, 2024) — компания, обещавшая клиентам «ИИ для создания миллионных бизнесов», использовала низкооплачиваемых работников для ручного управления магазинами. FTC признала их заявления фиктивными, а прибыль — результатом эксплуатации труда.

Scale AI — партнер OpenAI и Meta нанимал тысячи кенийских и филиппинских работников за 1-2 $ в час для маркировки данных. Несмотря на лозунги о «революции», 40% задач требовали ручной проверки. Time назвал это «цифровыми потогонками».

Кто должен нести ответственность?

Крах Nate и подобных компаний ставит острые вопросы. Почему инвесторы, вкладывающие миллионы, не проверяют реальные процессы? Как регулировать заявления о ИИ, которые оказались пустыми обещаниями? И главное, что делать с «невидимой» рабочей силой, трудящейся в тени алгоритмов?

Эксперты говорят, что фейковые ИИ будут множиться

С одной стороны, стартапы оправдываются: ручной труд — временная мера для обучения ИИ. Но, как показывает пример Nate, переход к автоматизации так и не происходит. Более того, работники из стран с низкими зарплатами становятся заложниками системы. Scale AI платил кенийцам 1,5 $ в час за модерацию контента, включая травмирующие материалы.

С другой — инвесторы слишком легко ведутся на хайп. Венчурные фонды хотят верить в сказку об ИИ, даже если для этого нужно закрыть глаза на реальность. Власти в разных странах начинают бороться с этим обманом, но пока судебных дел — единицы.

Также остается открытым и вопрос регулирования. Должны ли компании раскрывать долю человеческого труда в своих «ИИ-продуктах»? Как предотвратить эксплуатацию в глобальном масштабе? Пока ответов нет.

- Дмитрий Алексеев

- yandex.net

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

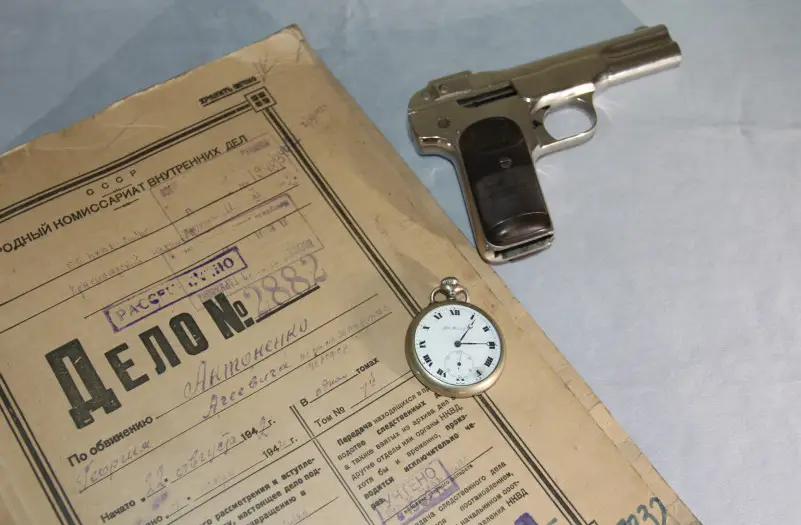

Рассекречены подробности убийства Кирова: данные из архива ФСО разрушили официальную версию как карточный домик

Эксперты говорят: Сталин был совершенно не при чем. Но он использовал эту бытовую драму в своих политических интересах...

Найдена могила… легендарного д’Артаньяна: какие артефакты обнаружили внутри?

Почему ученые вынуждены ждать окончательного признания этой исторической сенсации?...

У группы Дятлова все-таки был шанс: ИИ вычислил единственный вариант, когда люди могли спастись

Оказалось, что судьба туристов была решена уже в первые три минуты трагедии. И нейросеть нашла как именно...

Почему загадочные отметины на камнях в Помпеях десятилетиями ставили в тупик военных экспертов?

Итальянские ученые неожиданно решили одну из самых запутанных загадок римской военной истории. Оказывается, уже тогда стреляли из «пулеметов»...

Украина вообще не имеет шансов: французский историк, предсказавший распад СССР, не сомневается, что Россия победит

По словам эксперта, Запад исчерпал себя как цивилизация, а потому обречен на неизбежное поражение. Это необратимый процесс...

ФСБ рассекретила документы по процессу 1950 года: за что судили немецких военных?

Почему информация 75 лет находилась под грифом «Совершенно секретно», а День Победы не праздновали до 1965 года?...

Таинственный двойник обнаружился у египетского Сфинкса. И это только часть потрясающего открытия

Итальянские ученые, обнаружившие археологическую сенсацию, уверены: большую часть истории Древнего Египта придется переписать...

Советские МиГи… на самой секретной базе США: эта история стала публичной только в 2000-х годах

Эксперт рассказал, что делали самолеты из СССР в «Зоне-51» и почему американские военные зауважали русских конструкторов...

Страшнее Хиросимы и Нагасаки: как американская авиация превратила Японию в одни сплошные пылающие руины

Токио от зажигательных бомб горел так сильно, что люди, прятавшиеся в каналах и прудах, варились заживо...

Астронавт NASA внезапно потерял способность говорить в космосе, и врачи не знают почему

Эксперты говорят: инцидент на орбите может сильно не только космическую медицину, но вообще полеты на Луну и Марс...

Колумба могут оправдать… древние детские кости из Юго-Восточной Азии?

Что рассказали 309 скелетов во Вьетнаме? И почему история сифилиса — это очень непростая тема?...

ЦРУ массово создавало зомби-убийц: новое расследование подтвердило это еще раз

Эксперт уверен: убийца Кеннеди и самый известный американский маньяк — это продукты тогдашних экспериментов над сознанием...