Вредят науке: почему так важно разоблачать сгенерированные ИИ картинки

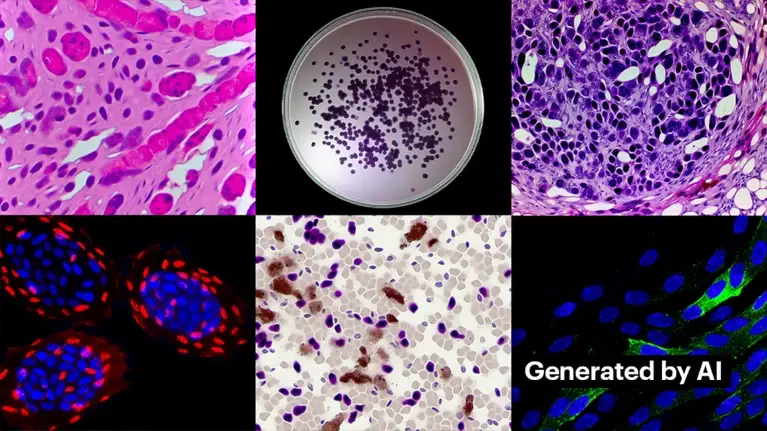

Технологии генеративного искусственного интеллекта могут с лёгкостью имитировать внешне убедительные научные данные. И теперь издатели профессиональной литературы и специалисты по проверке фактов опасаются потока фальшивок.

От недобросовестных исследователей, жонглирующих цифрами, до массового распространения лживых печатных статей — фальсифицированные сведения уже давно наводняют научную литературу. Вот почему соответствующие специалисты — научные детективы — неустанно выявляют ложь. Но такая борьба всё усложняется, так как мошенники осваивают генеративный ИИ.

Яна Кристофер работает аналитиком неизменности изображений в организации FEBS Press в Гейдельберге, Германия. Она рассказала, что инструментарий для вымышленной «науки» непрерывно развивается, и специалисты по целостности иллюстраций ощущают всё возрастающее беспокойство из-за возможностей, которые он даёт.

Лёгкость и скорость, с которой средства с ИИ могут генерировать текст, изображения и инфографику создают угрозу, что научная литература становится все менее достоверной, наполняясь фальшивыми цифрами, фиктивными рукописями и взятыми с потолка выводами, которые сложно распознать. Но уже сейчас начинается наступление на порождённую компьютерами псевдонаучность, поскольку контролёры достоверности, издатели и технологические компании стремятся создать для контрударов инструменты ИИ, которые помогут быстро выявлять обман в статьях.

Кристофер призналась, что развитие событий кажется ей пугающим. К тому же многие научные журналы уже разрешают использовать текст, «собранный» ИИ, пусть и с соблюдением неких правил. Но при этом сгенерированные изображения и другие визуальные иллюстрации вряд ли допустимы.

Элизабет Бик — специалист по криминалистической экспертизе изображений и консультант из Сан-Франциско. Она считает вполне вероятным, что в ближайшем будущем придётся смириться с текстом, созданным ИИ. Но подчеркнула, что точно не готова к имитации главного — наглядной информации.

Бик, Кристофер и другие научные детективы подозревают, что сгенерированные данные, в том числе изображения, уже расплодились в литературе. А также говорят о вероятности того, что издательства используют инструменты ИИ для массового производства рукописей.

Распознавание выдуманных ИИ картинок — очень трудная задача, так что это особенно сложная проблема. Зачастую их практически невозможно отличить от подлинных невооружённым глазом.

Рисунки, созданные с помощью «Фотошопа» и прочих графических редакторов, особенно подобные иллюстрации для текстов о молекулярной и клеточной биологии, часто содержали явные признаки, заметные специалистам. Например, отличались повторениями фона или странной прилизанностью. Рисунки от ИИ часто совершеннее. Бик сказала, что видит «тонны» подозрительных статей, но кажущихся странностей «недостаточно, чтобы писать редактору».

— Бик.

Уже существуют усиленные ИИ инструменты для борьбы с проблемой, например Imagetwin и Proofig. Разработчики такого программного обеспечения стремятся отсеивать порождённые в недобросовестных целях картинки. Затем фальсификат вносят в специально созданные базы данных, чтобы обучать на них алгоритмы.

В компании Proofig уже создали функцию для своего инструмента по обнаружению сгенерированных изображений на «фотографиях» микроскопии. Соучредитель компании Дрор Колодкин-Галь сказал, что при тестировании на тысячах картинок, созданных ИИ, и на подлинных изображениях из научных работ алгоритм в 98% случаев распознавал компьютерный фальсификат. При этом доля ложных срабатываний составила всего 0,02%.

Однако Кристофер заявила, что пока не видела доказательств надёжности ПО для распознавания изображений на основе ИИ. Вместе с тем она считает такие средства борьбы в принципе очень полезными, так как они облегчают работу по проверке на подлинность.

Многие издательства и исследовательские институты уже используют Proofig и Imagetwin. Например, Меган Фелан, директор по связям с общественностью журнала Science в Вашингтоне, заявила, что упомянутый инструмент у них пока не указывал на сгенерированные картинки. А компания Springer Nature, издающая журнал Nature, разрабатывает собственные инструменты для проверки текста и изображений под названием Geppetto и SnapShot. Сначала это ПО выявляет несоответствия, а затем оценка даётся независимыми экспертами-людьми. В общем, совершенства в автоматизации пока не достигли.

От недобросовестных исследователей, жонглирующих цифрами, до массового распространения лживых печатных статей — фальсифицированные сведения уже давно наводняют научную литературу. Вот почему соответствующие специалисты — научные детективы — неустанно выявляют ложь. Но такая борьба всё усложняется, так как мошенники осваивают генеративный ИИ.

Яна Кристофер работает аналитиком неизменности изображений в организации FEBS Press в Гейдельберге, Германия. Она рассказала, что инструментарий для вымышленной «науки» непрерывно развивается, и специалисты по целостности иллюстраций ощущают всё возрастающее беспокойство из-за возможностей, которые он даёт.

Лёгкость и скорость, с которой средства с ИИ могут генерировать текст, изображения и инфографику создают угрозу, что научная литература становится все менее достоверной, наполняясь фальшивыми цифрами, фиктивными рукописями и взятыми с потолка выводами, которые сложно распознать. Но уже сейчас начинается наступление на порождённую компьютерами псевдонаучность, поскольку контролёры достоверности, издатели и технологические компании стремятся создать для контрударов инструменты ИИ, которые помогут быстро выявлять обман в статьях.

Кристофер призналась, что развитие событий кажется ей пугающим. К тому же многие научные журналы уже разрешают использовать текст, «собранный» ИИ, пусть и с соблюдением неких правил. Но при этом сгенерированные изображения и другие визуальные иллюстрации вряд ли допустимы.

Элизабет Бик — специалист по криминалистической экспертизе изображений и консультант из Сан-Франциско. Она считает вполне вероятным, что в ближайшем будущем придётся смириться с текстом, созданным ИИ. Но подчеркнула, что точно не готова к имитации главного — наглядной информации.

Бик, Кристофер и другие научные детективы подозревают, что сгенерированные данные, в том числе изображения, уже расплодились в литературе. А также говорят о вероятности того, что издательства используют инструменты ИИ для массового производства рукописей.

Распознавание выдуманных ИИ картинок — очень трудная задача, так что это особенно сложная проблема. Зачастую их практически невозможно отличить от подлинных невооружённым глазом.

Рисунки, созданные с помощью «Фотошопа» и прочих графических редакторов, особенно подобные иллюстрации для текстов о молекулярной и клеточной биологии, часто содержали явные признаки, заметные специалистам. Например, отличались повторениями фона или странной прилизанностью. Рисунки от ИИ часто совершеннее. Бик сказала, что видит «тонны» подозрительных статей, но кажущихся странностей «недостаточно, чтобы писать редактору».

Вместе с тем тексты, состряпанные, например, ChatGPT, выдают себя стандартными фразами чат-ботов, которые люди-полуавторы забывают вычистить, и характерными словами, свойственными ИИ. Такая тенденция позволяет предположить, что подобное происходит и с графиками, и с изображениями

— Бик.

Уже существуют усиленные ИИ инструменты для борьбы с проблемой, например Imagetwin и Proofig. Разработчики такого программного обеспечения стремятся отсеивать порождённые в недобросовестных целях картинки. Затем фальсификат вносят в специально созданные базы данных, чтобы обучать на них алгоритмы.

В компании Proofig уже создали функцию для своего инструмента по обнаружению сгенерированных изображений на «фотографиях» микроскопии. Соучредитель компании Дрор Колодкин-Галь сказал, что при тестировании на тысячах картинок, созданных ИИ, и на подлинных изображениях из научных работ алгоритм в 98% случаев распознавал компьютерный фальсификат. При этом доля ложных срабатываний составила всего 0,02%.

Однако Кристофер заявила, что пока не видела доказательств надёжности ПО для распознавания изображений на основе ИИ. Вместе с тем она считает такие средства борьбы в принципе очень полезными, так как они облегчают работу по проверке на подлинность.

Многие издательства и исследовательские институты уже используют Proofig и Imagetwin. Например, Меган Фелан, директор по связям с общественностью журнала Science в Вашингтоне, заявила, что упомянутый инструмент у них пока не указывал на сгенерированные картинки. А компания Springer Nature, издающая журнал Nature, разрабатывает собственные инструменты для проверки текста и изображений под названием Geppetto и SnapShot. Сначала это ПО выявляет несоответствия, а затем оценка даётся независимыми экспертами-людьми. В общем, совершенства в автоматизации пока не достигли.

- Дмитрий Ладыгин

- proofig.com

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

40 лет молчания: где «прятался» пропавший советский луноход?

Исчез внезапно, внезапно вернулся ярко. Почему астрофизики были так рады, когда «Луноход-1» наконец-то нашелся?...

Ледник Судного дня угрожает России: эксперт рассказал, какие города затопит первыми

Через 40 лет Крым может стать островом, а Санкт-Петербург — вообще скрыться под водой...

Странные звуки рядом с Кольской сверхглубокой снова беспокоят местных жителей

12 000 метров глубины, Луна под ногами, «совершенно секретно», неожиданное закрытие. Вспоминаем историю самой глубокой скважины на планете...

Груды скелетов в подземельях Кремля: что скрывается за этими находками?

Археологи говорят: московская земля прячет в себе такие тайны, которые лучше не знать никогда...

Снова утечка воздуха в российском секторе МКС: чем это грозит нашим и всей станции?

По словам специалистов: в 2026 году поломка вошла в цикл. Космонавты устраняют проблему, радуются, а через три недели — снова проблемы...

Освобождение от доллара: почему Сталин сделал рубль «золотым»?

Историки говорят: это было очень сильное решение. Теперь западные партнеры не могли ронять цены на советский импорт...

Чернила №1 в мире: как русский купец Луковников создал идеальную формулу для письма

Разгромил иностранных конкурентов, получил множество наград и стал… призраком в истории...

743 странных узора-короны рассказали, почему Венера не стала второй Землей

Оказалось, соседней планете не хватило «смазки», чтобы там зародилась жизнь...

Город-Счастье: древний мегаполис оказался местом без олигархов и бедных

Чем богаче становился Мохенджо-Даро, тем лучше жили все граждане. Похоже, сейчас наша цивилизация движется куда-то не туда...

Струей плазмы — по микробам: грязная тайна МКС наконец-то решена

Эксперты говорят: «стиралка» для невесомости — это лучшее космическое изобретение за последние годы...

Они захватили Землю, когда астероид уничтожил динозавров

И едва не уничтожили все живое на планете...