Новый инструмент обнаруживает видео, созданные искусственным интеллектом, с точностью 93,7%

В этом году сотрудник многонациональной корпорации перевел мошенникам 25 млн долларов. Инструкции по переводу денег, как он думал, ему прислал финансовый директор компании. На самом деле преступники использовали программу искусственного интеллекта для создания реалистичных видеороликов с участием финдиректора и нескольких коллег бедолаги.

Видеоролики, созданные искусственным интеллектом, стали настолько реалистичными, что люди (и существующие системы обнаружения) испытывают трудности с различением настоящего и поддельного видео. Чтобы решить эту проблему, исследователи из Колумбийского инженерного факультета под руководством профессора компьютерных наук Чжунфэн Янга разработали новый инструмент для обнаружения видеороликов, созданных искусственным интеллектом.

Инструмент назвали DIVID (DIffusion-generated VIdeo Detector). Он расширяет проект команды, выпустившей ранее инструмент Raidar. Программа обнаруживает тексты, созданные искусственным интеллектом, анализируя их содержимое, без необходимости доступа к внутренним механизмам больших языковых моделей.

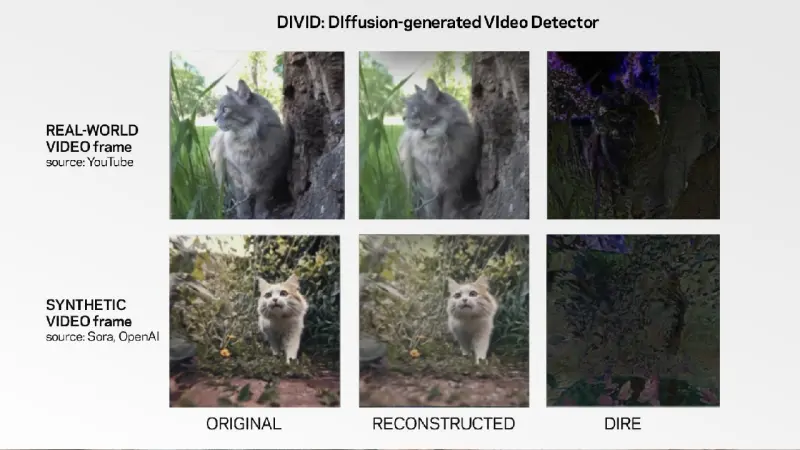

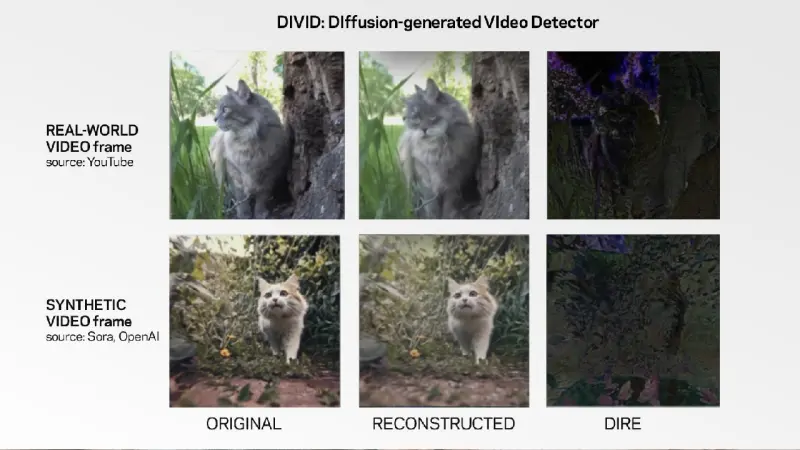

В первом столбце на фото: видеокадры с YouTube и фейковые видеоролики, созданные OpenAI из Sora. Во втором — кадры, восстановленные методом диффузии, а в конце отражены различия между первым и вторым столбцами.

DIRE (Ошибка реконструкции DIffusion) — это метод, который измеряет разницу между входным и соответствующим выходным изображением, восстановленным с помощью предварительно обученной диффузионной модели.

Как демонстрирует иллюстрация, реальные видеокадры имеют больше отличий от восстановленных кадров, чем от видео, созданного диффузией Это и является ключевым моментом для DIVID в обнаружении фальшивого видео.

DIVID обнаруживает новое поколение видеороликов, созданных генеративным искусственным интеллектом. Он улучшает существующие методы, которые эффективно выявляют видео, созданные старыми моделями ИИ, такими как генеративные антагонистические сети (GAN).

GAN — это система искусственного интеллекта с двумя нейронными сетями: одна создает фальшивые данные, а другая оценивает их, чтобы отличать поддельное от реального. Путем непрерывной обратной связи обе сети улучшаются, что приводит к высококачественному синтетическому видео, практически неотличимому от подлинного.

Текущие инструменты обнаружения искусственного интеллекта ищут характерные признаки — необычное расположение пикселей, ненатуральные движения или несоответствия между кадрами, которые обычно не возникают в реальных видео. Однако новое поколение инструментов с использованием диффузионной модели бросило вызов в области обнаружения фейков.

Raidar использует языковую модель для переформулирования или изменения текста, а затем измеряет количество правок, внесенных системой в исходный текст. Большое количество правок означает, что текст, скорее всего, написан человеком, в то время как меньшее число модификаций указывает на то, что текст, скорее всего, создан машиной.

— Янг.

Научная статья, включающая в себя открытый код и наборы данных, была представлена на конференции по компьютерному зрению и распознаванию образов (CVPR) в Сиэтле 18 июня 2024 года.

В настоящее время исследователи работают над улучшением платформы DIVID, чтобы она могла обрабатывать различные виды синтетических видео из инструментов создания видео с открытым исходным кодом. Они также используют DIVID для сбора видео для набора данных DIVID.

Видеоролики, созданные искусственным интеллектом, стали настолько реалистичными, что люди (и существующие системы обнаружения) испытывают трудности с различением настоящего и поддельного видео. Чтобы решить эту проблему, исследователи из Колумбийского инженерного факультета под руководством профессора компьютерных наук Чжунфэн Янга разработали новый инструмент для обнаружения видеороликов, созданных искусственным интеллектом.

Инструмент назвали DIVID (DIffusion-generated VIdeo Detector). Он расширяет проект команды, выпустившей ранее инструмент Raidar. Программа обнаруживает тексты, созданные искусственным интеллектом, анализируя их содержимое, без необходимости доступа к внутренним механизмам больших языковых моделей.

В первом столбце на фото: видеокадры с YouTube и фейковые видеоролики, созданные OpenAI из Sora. Во втором — кадры, восстановленные методом диффузии, а в конце отражены различия между первым и вторым столбцами.

DIRE (Ошибка реконструкции DIffusion) — это метод, который измеряет разницу между входным и соответствующим выходным изображением, восстановленным с помощью предварительно обученной диффузионной модели.

Как демонстрирует иллюстрация, реальные видеокадры имеют больше отличий от восстановленных кадров, чем от видео, созданного диффузией Это и является ключевым моментом для DIVID в обнаружении фальшивого видео.

DIVID обнаруживает новое поколение видеороликов, созданных генеративным искусственным интеллектом. Он улучшает существующие методы, которые эффективно выявляют видео, созданные старыми моделями ИИ, такими как генеративные антагонистические сети (GAN).

GAN — это система искусственного интеллекта с двумя нейронными сетями: одна создает фальшивые данные, а другая оценивает их, чтобы отличать поддельное от реального. Путем непрерывной обратной связи обе сети улучшаются, что приводит к высококачественному синтетическому видео, практически неотличимому от подлинного.

Текущие инструменты обнаружения искусственного интеллекта ищут характерные признаки — необычное расположение пикселей, ненатуральные движения или несоответствия между кадрами, которые обычно не возникают в реальных видео. Однако новое поколение инструментов с использованием диффузионной модели бросило вызов в области обнаружения фейков.

Преобразование текстов, сгенерированных AI Raidar, в видео

Raidar использует языковую модель для переформулирования или изменения текста, а затем измеряет количество правок, внесенных системой в исходный текст. Большое количество правок означает, что текст, скорее всего, написан человеком, в то время как меньшее число модификаций указывает на то, что текст, скорее всего, создан машиной.

Основное открытие заключается в том, что данные, полученные от ИИ, другие языковые модели оценивают как качественые, поэтому ИИ вносит меньше правок. Учитывая, что генерируемое видео становится все более реалистичным, мы решили взять идею из Raidar и создать инструмент, который точно определит видео, созданное ИИ

— Янг.

Научная статья, включающая в себя открытый код и наборы данных, была представлена на конференции по компьютерному зрению и распознаванию образов (CVPR) в Сиэтле 18 июня 2024 года.

В настоящее время исследователи работают над улучшением платформы DIVID, чтобы она могла обрабатывать различные виды синтетических видео из инструментов создания видео с открытым исходным кодом. Они также используют DIVID для сбора видео для набора данных DIVID.

- Алексей Павлов

- Software Systems Laboratory/Columbia Engineering

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Заговор молчания вокруг Тунгусского метеорита: почему мы могли бы вообще не узнать о нем?

Историки рассказали, почему император Николай, правительство и ученые предпочли не увидеть главную космическую сенсацию начала ХХ века...

Потерянный град царя Бориса: как погибла третья русская столица?

Царев-Борисов городок должен был затмить Москву. Почему же все вышло иначе?...

140 стрел и пепел раскрыли тайну гибели самого загадочного города Руси, Гнездово

Город не зачах, не был расселен из-за политических разборок, его уничтожили быстро и жестоко...

Еще одна загадка Ивана Сусанина: что не так с ДНК народного героя?

Почему этот исторический детектив длиной 400 лет никак не могут распутать ученые?...

Стало известно о 9000-летней строительной технологии, которую почти невозможно повторить даже сейчас

Древним секретом активно интересуются сразу две ведущие промышленные организации в Израиле. Интересно, почему?...

Ельцин не должен был победить: кого Горбачев хотел сделать президентом России?

Почему этот план с самого начала был обречен на поражение?...

Археологи МГУ нашли «тайники» в одном из древнейших «храмов» в России

Поразительно, по словам ученых, как минимум 40 000 лет здесь не прерываются религиозные традиции и обряды...

Почему у самого большого железного метеорита на Земле вообще нет кратера?

Астрофизики говорят: метеорит Хоба в Намибии нарушает все правила природы вот уже 80 000 лет...

Пять часов, и свободен! Зачем Сталин хотел сократить рабочий день?

Почему современные эксперты говорят, что это невозможно? И кто, вообще, не дает сократить рабочий день?...

Полтергейстами командует… Солнце? К таким парадоксальным выводам пришел ученый из Иркутска

Странная на первый взгляд гипотеза, как оказалось, основывается на многочисленных фактах...

Почему ваш робот пылесос шпионит за вами, а дрон над дачей — это разведка перед ограблением?

Эксперты рассказали: число преступлений с помощью ИИ выросло на 1210%. И это только начало...

Правительство США рассекретило почти 200 файлов о неопознанных воздушных явлениях

Американские власти и Пентагон признаются: по большинству фактов нет однозначных решений. Почему?...