Исследователи рассказали о том, как нейросети воспринимают действительность

Наши сенсорные системы очень хорошо распознают объекты, которые мы видим, или слова, которые слышим, даже если объекты перевернуты или речь произнесена неизвестным нам голосом. Вычислительные модели, такие как глубокие нейронные сети, могут быть обучены делать то же самое, например, правильно определяя изображение собаки, независимо от цвета ее шерсти, или распознавая речь, независимо от тембра голоса говорящего.

Тем не менее новое исследование нейробиологов из Массачусетского технологического института показало, что нейронные сети часто дают точно такой же ответ при обработке изображений или речи, которые не имеют никакого сходства с поставленными в задаче примерами.

Слева — изображение медведя, полученное естественным путём и переданное нейросети.

Справа — пример того, что модель определила как «медведь»

Считается, что человеческая сенсорная система учится игнорировать элементы, которые не имеют отношения к существенным признакам объекта. Человек способен создать инвариантное представление о классе объекта независимо от незначительных факторов, таких как уровень освещения или угол обзора.

—Джанелл Фезер, доктор философии Института Флэтайрон.

Исследователи задались вопросом, могут ли глубокие нейронные сети, обученные выполнять задачи классификации, развивать собственные инварианты? Чтобы попытаться ответить на этот вопрос, они использовали вычислительные модели для создания стимулов, производящих тот же тип ответа в модели, как и от стимулов, предоставленных исследователями.

Было обнаружено, что большинство изображений и звуков, созданных таким образом, выглядели и звучали совершенно не так, как примеры, которые модели получали изначально. Часть изображений была мешаниной случайно расположенных пикселей, а звуки напоминали неразборчивый шум.

—Джанелл Фезер.

Результаты исследования показывают, что модели каким-то образом разработали свои собственные инварианты. Это заставляет модели воспринимать пары стимулов как одинаковые, несмотря на их радикальные отличия для людей. Проблема может лежать в разнице между архитектурой глубоких нейронных сетей и человеческого мозга.

—Джош Макдермотт, доцент кафедры мозга и когнитивных наук Массачусетского технологического института.

Тем не менее новое исследование нейробиологов из Массачусетского технологического института показало, что нейронные сети часто дают точно такой же ответ при обработке изображений или речи, которые не имеют никакого сходства с поставленными в задаче примерами.

Слева — изображение медведя, полученное естественным путём и переданное нейросети.

Справа — пример того, что модель определила как «медведь»

Считается, что человеческая сенсорная система учится игнорировать элементы, которые не имеют отношения к существенным признакам объекта. Человек способен создать инвариантное представление о классе объекта независимо от незначительных факторов, таких как уровень освещения или угол обзора.

Традиционно считается, что сенсорные системы создают инварианты ко всем содержащимся в экземплярах одного объекта вариациям. Наш организм обязан установить, что мы наблюдаем или слышим одно и тоже, несмотря на незначительные различия.

—Джанелл Фезер, доктор философии Института Флэтайрон.

Исследователи задались вопросом, могут ли глубокие нейронные сети, обученные выполнять задачи классификации, развивать собственные инварианты? Чтобы попытаться ответить на этот вопрос, они использовали вычислительные модели для создания стимулов, производящих тот же тип ответа в модели, как и от стимулов, предоставленных исследователями.

Разница в восприятии

Было обнаружено, что большинство изображений и звуков, созданных таким образом, выглядели и звучали совершенно не так, как примеры, которые модели получали изначально. Часть изображений была мешаниной случайно расположенных пикселей, а звуки напоминали неразборчивый шум.

Результаты работы нейронных сетей вообще не узнаваемы для людей. Они не выглядят и не звучат естественно, и у них нет интерпретируемых характеристик, которые человек мог бы использовать для классификации объекта или слова.

—Джанелл Фезер.

Результаты исследования показывают, что модели каким-то образом разработали свои собственные инварианты. Это заставляет модели воспринимать пары стимулов как одинаковые, несмотря на их радикальные отличия для людей. Проблема может лежать в разнице между архитектурой глубоких нейронных сетей и человеческого мозга.

Мы думаем, что это интересное и полезное направление для дальнейших исследований. Двигаясь дальше мы сможем понять, какие аспекты нашего восприятия и обучения уникальны для нас как людей и что делает нас такими, как мы есть.

—Джош Макдермотт, доцент кафедры мозга и когнитивных наук Массачусетского технологического института.

- Алексей Павлов

- Массачусетский технологический институт

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Ельцин не должен был победить: кого Горбачев хотел сделать президентом России?

Почему этот план с самого начала был обречен на поражение?...

Судьба имперских субмарин решена: почему они останутся на дне Крыма навсегда?

Как военные судна вообще оказались затоплены и кто мешал их изучению долгие десятилетия?...

140 стрел и пепел раскрыли тайну гибели самого загадочного города Руси, Гнездово

Город не зачах, не был расселен из-за политических разборок, его уничтожили быстро и жестоко...

Токийская декларация-1993: какую бомбу заложил Ельцин под Россию?

Эксперты говорят: российский президент хотел переиграть Токио, но в итоге дал японцам мощный рычаг воздействия на нашу страну...

Еще одна загадка Ивана Сусанина: что не так с ДНК народного героя?

Почему этот исторический детектив длиной 400 лет никак не могут распутать ученые?...

Почему у самого большого железного метеорита на Земле вообще нет кратера?

Астрофизики говорят: метеорит Хоба в Намибии нарушает все правила природы вот уже 80 000 лет...

Стало известно о 9000-летней строительной технологии, которую почти невозможно повторить даже сейчас

Древним секретом активно интересуются сразу две ведущие промышленные организации в Израиле. Интересно, почему?...

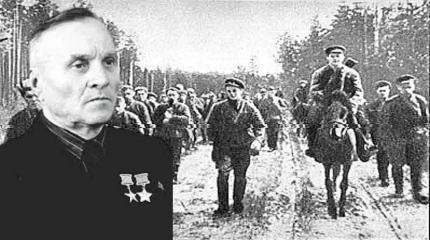

Архив ФСБ раскрыл детали одной из самых дерзких диверсионных операций ВОВ

Биография Кирилла Орловского поражает. Две Звезды Героя, друг писателя Хемингуэя, ликвидатор нацистских палачей, председатель лучшего колхоза СССР...

Удар, который едва не расколол Луну пополам: кратер в 1/10 площади планеты оставил не просто астероид

Столкновение было настолько мощным, что на поверхность выбросило породы с глубины… почти 100 километров!...

Биоинженер провел 100 дней под водой. По его словам, это прибавило ему 10 лет жизни

Почему этот эксперимент вызвал массу критики? Кто победит, официальная теория или опытная практика?...

Правительство США рассекретило почти 200 файлов о неопознанных воздушных явлениях

Американские власти и Пентагон признаются: по большинству фактов нет однозначных решений. Почему?...