Негативные «ретвиты», похоже, укрепляют теории заговора о мошенничестве на выборах

Группа учёных-бихевиористов, использующая большие данные и симуляционную модель для анализа «твитов» в социальных сетях в период президентских выборов 2020 года в США, обнаружила, что распространению теорий заговора о мошенничестве на выборах в Твиттере (теперь называемом X) способствовала предвзятость негатива. Результаты исследования под руководством Мэйсона Янгблада, доктора философии, научного сотрудника Института перспективных вычислительных наук Университета Стоуни-Брук, опубликованы в журнале Humanities and Social Sciences Communications.

Исследователи смоделировали поведение около 350 000 реальных пользователей Twitter. Они обнаружили, что шаблоны обмена примерно 4 миллионами твитов о фальсификациях на выборах согласуются с тем, что люди с гораздо большей вероятностью ретвитят посты в социальных сетях, которые содержат более сильные негативные эмоции.

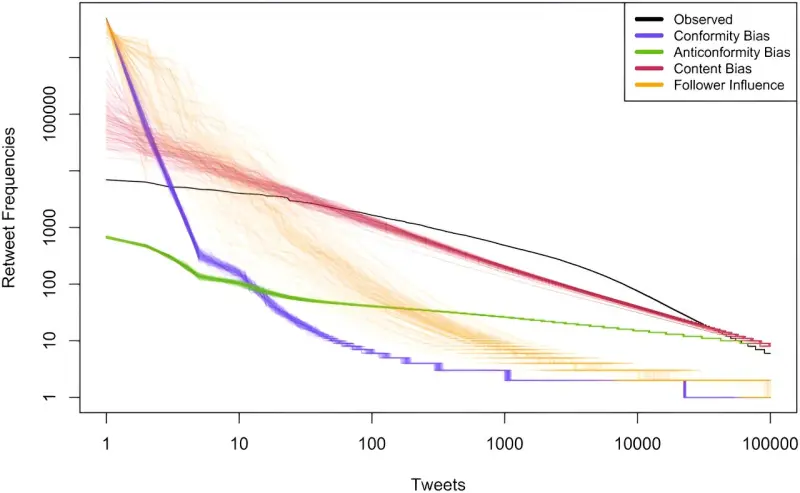

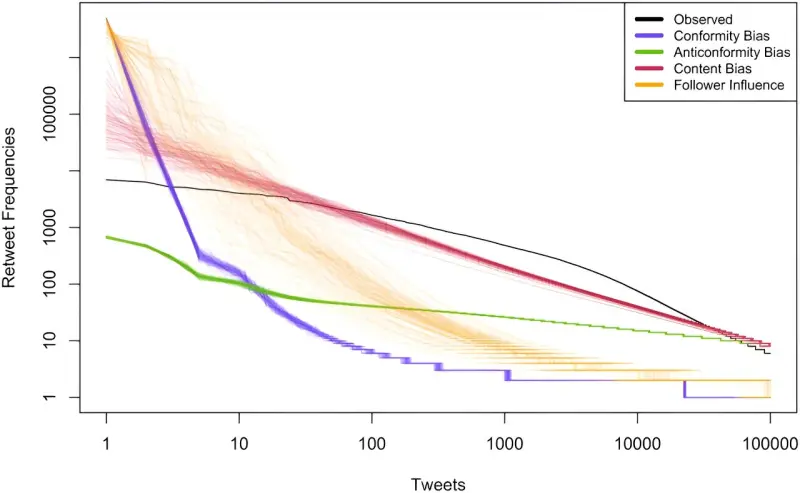

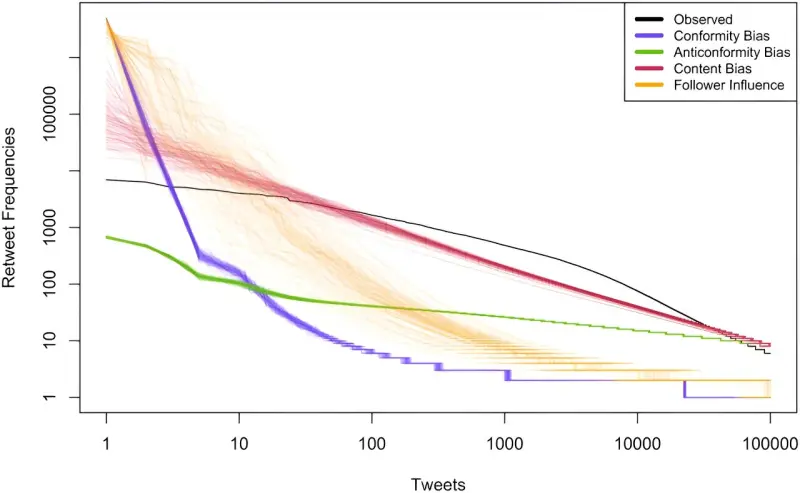

Распределение ретвитов в результате соответствия, антиконформности, содержания и влияния подписчиков с использованием этого ABM (по 100 итераций каждая), наряду с наблюдаемым распределением ретвитов (черным цветом). Все предвзятости были смоделированы с g 0,25 и следующими значениями параметров: a = 1,4 (предвзятость соответствия), a = 0,6 (предвзятость антисогласия), c = 1 (предвзятость контента) и d = 1 (влияние подписчиков). Ось X — это идентификатор каждого твита, ранжированный по убыванию количества ретвитов, а ось Y показывает количество ретвитов каждого из этих твитов. Обе оси были логарифмически преобразованы.

Данные для их исследования были взяты из набора данных VoterFraud2020, собранного в период с 23 октября по 16 декабря 2020 года. Этот набор данных включает 7,6 миллиона твитов и 25,6 миллиона ретвитов, которые были собраны в режиме реального времени с использованием программного интерфейса потоковой передачи X в соответствии с установленными правилами для этичного использования данных из социальных сетей.

— Мэйсон Янгблад.

Учитывая это, команда провела моделирование того, как отдельные пользователи пишут и ретвитят друг друга в Твиттере с разными уровнями и формами когнитивной предвзятости, и сравнила полученные результаты с реальными моделями поведения ретвитов среди сторонников теорий заговора с мошенничеством на выборах во время и вокруг выборов.

— Мэйсон Янгблад.

С помощью моделирования и численного анализа Янгблад и его коллеги обнаружили, что полученные результаты согласуются с предыдущими исследованиями других авторов, предполагающими, что эмоционально негативный контент имеет преимущество в социальных сетях в различных областях, включая освещение новостей и политический дискурс.

Модель также показала, что, хотя негативные твиты с большей вероятностью ретвитировались, твиты с цитатами, как правило, были более умеренными, чем оригинальные, поскольку люди, как правило, не усиливали негатив, комментируя что-либо.

Янгблад считает, что, поскольку модель, основанная на симуляции, достаточно хорошо воссоздает закономерности в реальных данных, она потенциально может быть полезна для моделирования мер против дезинформации в будущем. Модель можно использовать для создания инструментов, используя которые компании или политики могут попытаться ограничить распространение информации, например, снизить скорость попадания твитов в новостные ленты.

Исследователи смоделировали поведение около 350 000 реальных пользователей Twitter. Они обнаружили, что шаблоны обмена примерно 4 миллионами твитов о фальсификациях на выборах согласуются с тем, что люди с гораздо большей вероятностью ретвитят посты в социальных сетях, которые содержат более сильные негативные эмоции.

Распределение ретвитов в результате соответствия, антиконформности, содержания и влияния подписчиков с использованием этого ABM (по 100 итераций каждая), наряду с наблюдаемым распределением ретвитов (черным цветом). Все предвзятости были смоделированы с g 0,25 и следующими значениями параметров: a = 1,4 (предвзятость соответствия), a = 0,6 (предвзятость антисогласия), c = 1 (предвзятость контента) и d = 1 (влияние подписчиков). Ось X — это идентификатор каждого твита, ранжированный по убыванию количества ретвитов, а ось Y показывает количество ретвитов каждого из этих твитов. Обе оси были логарифмически преобразованы.

Данные для их исследования были взяты из набора данных VoterFraud2020, собранного в период с 23 октября по 16 декабря 2020 года. Этот набор данных включает 7,6 миллиона твитов и 25,6 миллиона ретвитов, которые были собраны в режиме реального времени с использованием программного интерфейса потоковой передачи X в соответствии с установленными правилами для этичного использования данных из социальных сетей.

Теории заговора о крупномасштабных фальсификациях на выборах широко и быстро распространились в Твиттере во время президентских выборов в США в 2020 году, но неясно, какие процессы ответственны за их распространение

— Мэйсон Янгблад.

Учитывая это, команда провела моделирование того, как отдельные пользователи пишут и ретвитят друг друга в Твиттере с разными уровнями и формами когнитивной предвзятости, и сравнила полученные результаты с реальными моделями поведения ретвитов среди сторонников теорий заговора с мошенничеством на выборах во время и вокруг выборов.

Наши результаты показывают, что распространение сообщений о мошенничестве на выборах в Твиттере было вызвано предвзятостью к твитам с более негативными эмоциями, и это имеет важные последствия для текущих дебатов о том, как противостоять распространению теорий заговора и дезинформации в социальных сетях

— Мэйсон Янгблад.

С помощью моделирования и численного анализа Янгблад и его коллеги обнаружили, что полученные результаты согласуются с предыдущими исследованиями других авторов, предполагающими, что эмоционально негативный контент имеет преимущество в социальных сетях в различных областях, включая освещение новостей и политический дискурс.

Модель также показала, что, хотя негативные твиты с большей вероятностью ретвитировались, твиты с цитатами, как правило, были более умеренными, чем оригинальные, поскольку люди, как правило, не усиливали негатив, комментируя что-либо.

Янгблад считает, что, поскольку модель, основанная на симуляции, достаточно хорошо воссоздает закономерности в реальных данных, она потенциально может быть полезна для моделирования мер против дезинформации в будущем. Модель можно использовать для создания инструментов, используя которые компании или политики могут попытаться ограничить распространение информации, например, снизить скорость попадания твитов в новостные ленты.

- Алексей Павлов

- Humanities and Social Sciences Communications

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Ельцин не должен был победить: кого Горбачев хотел сделать президентом России?

Почему этот план с самого начала был обречен на поражение?...

Судьба имперских субмарин решена: почему они останутся на дне Крыма навсегда?

Как военные судна вообще оказались затоплены и кто мешал их изучению долгие десятилетия?...

140 стрел и пепел раскрыли тайну гибели самого загадочного города Руси, Гнездово

Город не зачах, не был расселен из-за политических разборок, его уничтожили быстро и жестоко...

Токийская декларация-1993: какую бомбу заложил Ельцин под Россию?

Эксперты говорят: российский президент хотел переиграть Токио, но в итоге дал японцам мощный рычаг воздействия на нашу страну...

Еще одна загадка Ивана Сусанина: что не так с ДНК народного героя?

Почему этот исторический детектив длиной 400 лет никак не могут распутать ученые?...

Почему у самого большого железного метеорита на Земле вообще нет кратера?

Астрофизики говорят: метеорит Хоба в Намибии нарушает все правила природы вот уже 80 000 лет...

Стало известно о 9000-летней строительной технологии, которую почти невозможно повторить даже сейчас

Древним секретом активно интересуются сразу две ведущие промышленные организации в Израиле. Интересно, почему?...

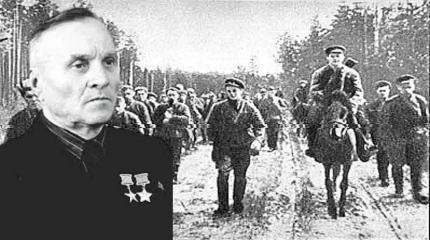

Архив ФСБ раскрыл детали одной из самых дерзких диверсионных операций ВОВ

Биография Кирилла Орловского поражает. Две Звезды Героя, друг писателя Хемингуэя, ликвидатор нацистских палачей, председатель лучшего колхоза СССР...

Удар, который едва не расколол Луну пополам: кратер в 1/10 площади планеты оставил не просто астероид

Столкновение было настолько мощным, что на поверхность выбросило породы с глубины… почти 100 километров!...

Биоинженер провел 100 дней под водой. По его словам, это прибавило ему 10 лет жизни

Почему этот эксперимент вызвал массу критики? Кто победит, официальная теория или опытная практика?...

Правительство США рассекретило почти 200 файлов о неопознанных воздушных явлениях

Американские власти и Пентагон признаются: по большинству фактов нет однозначных решений. Почему?...

Иран «ставит на счетчик» мировой интернет: сможет ли Тегеран заставить Запад платить за кабели в Ормузе?

Как оказалось, нефть была только началом. Теперь Тегеран берет за горло западную цифровую экономику...