Brain2Music использует мысли для воспроизведения музыки

Исследователи из Google и Университета Осаки в Японии изучающие активность мозга сообщили об успехах в воссоздании музыки по волнам человеческого мозга, наблюдаемым в лаборатории. Статья команды «Brain2Music: реконструкция музыки по деятельности человеческого мозга» была опубликована на сервере препринтов arXiv 20 июля.

Музыкальные образцы, охватывающие 10 жанров, включая рок, классику, металл, хип-хоп, поп и джаз, воспроизводились для пяти испытуемых, в то время как исследователи наблюдали за их мозговой активностью. Во время прослушивания записывались показания функциональной МРТ (fMRI). (Показания фМРТ, в отличие от показаний МРТ, регистрируют метаболическую активность с течением времени.)

Затем показания использовались для обучения глубокой нейронной сети, которая выявляла алгоритм, связанный с различными характеристиками музыки, такими как жанр, настроение и инструменты.

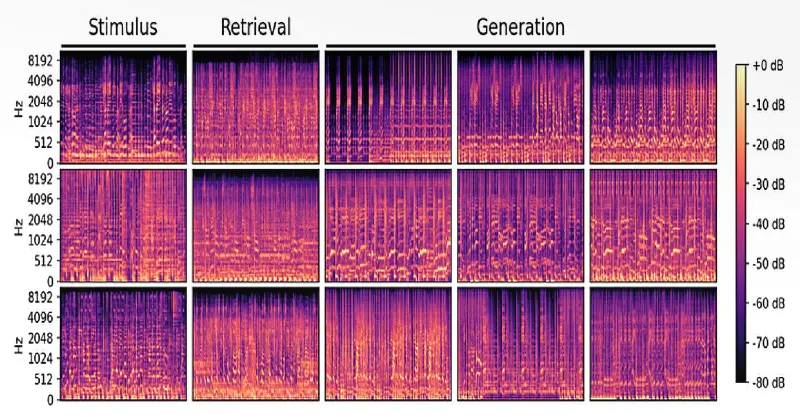

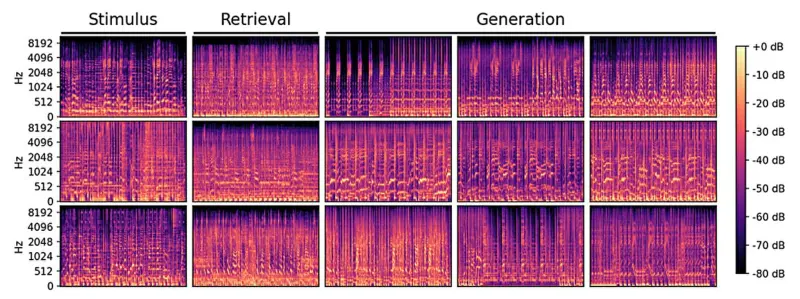

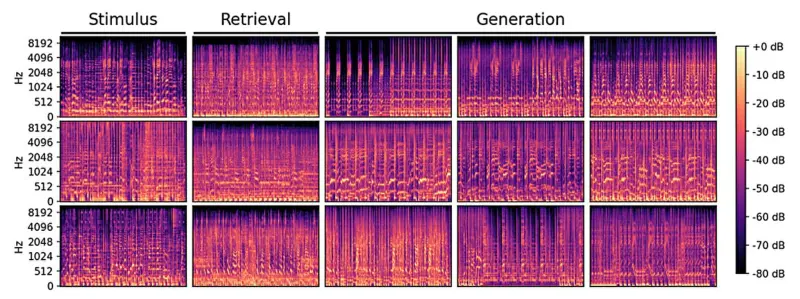

Спектрограммы различных музыкальных клипов: Крайний левый столбец содержит стимулы, которым подвергались испытуемые. Справа музыка, полученная из FMA, и три клипа, взятые из MusicLM. Как генерация, так и поиск выполняются с помощью вложений MuLan. Визуально заметно сходство спектрограмм в одном ряду.

На промежуточном этапе к исследованию присоединился MusicLM. Эта модель, разработанная Google, генерирует музыку на основе текстовых описаний. Он, как и фМРТ, измеряет такие факторы, как инструментарий, ритм и эмоции.

Исследователи связали базу данных MusicLM с показаниями фМРТ, что позволило их модели ИИ реконструировать музыку, которую слышали испытуемые. Вместо текстовых инструкций активность мозга обеспечивала контекст для музыкального вывода.

— Тимо Денк, исследователь из Google, один из нескольких авторов статьи.

Авторы назвали созданную модель ИИ Brain2Music.

Созданная музыка напоминает музыкальные стимулы, которые испытали люди, в отношении семантических свойств, таких как жанр, инструменты и настроение. Кроме того, ученые определили области мозга, отражающие информацию, поступающую из текстовых описаний музыки.

Примеры, предоставленные командой, демонстрируют удивительно похожее звучание музыкальных отрывков, интерпретируемых Brain2Music на основе мозговых волн испытуемых.

Одна из семплированных песен присутствовала среди первых 10 лучших хитов 2000 года «Oops!.. I Did It Again» Бритни Спирс. Ряд музыкальных элементов песни, таких как звучание инструментов и ритм, точно соответствовали друг другу, хотя тексты были неразборчивы. Исследователи объяснили, что Brain2Go фокусируется на инструментовке и стиле, а не на текстах.

— Тимо Денк.

ИИ еще не готов проникнуть в наш мозг и записать идеально оркестрованные мелодии, но этот день может быть не за горами.

По словам Денка, будущая работа над моделями генерации музыки улучшит временное согласование между реконструкцией и стимулом. Он также предположил, что в будущем появятся еще более точные методы воспроизведения музыкальных композиций, основанные на чистом воображении.

Возможно, будущим авторам песен нужно будет только представить припев песни, пока принтер, подключенный по беспроводной связи к слуховой коре, распечатывает партитуру.

Так Пол Маккартни, автор песни «Yesterday», признанной в опросе BBC в 1999 году лучшей песней 20-го века, рассказывал, что идея этой песни пришла к нему во сне, однако ему потребовалось полтора года, чтобы заполнить все недостающие части. Если будущий Маккартни придумает потенциальный глобальный хит в полуночном сне, вполне возможно, что модель типа Brain2Go обеспечит полный, быстрый и точный рендеринг композиции уже утром.

Музыкальные образцы, охватывающие 10 жанров, включая рок, классику, металл, хип-хоп, поп и джаз, воспроизводились для пяти испытуемых, в то время как исследователи наблюдали за их мозговой активностью. Во время прослушивания записывались показания функциональной МРТ (fMRI). (Показания фМРТ, в отличие от показаний МРТ, регистрируют метаболическую активность с течением времени.)

Затем показания использовались для обучения глубокой нейронной сети, которая выявляла алгоритм, связанный с различными характеристиками музыки, такими как жанр, настроение и инструменты.

Спектрограммы различных музыкальных клипов: Крайний левый столбец содержит стимулы, которым подвергались испытуемые. Справа музыка, полученная из FMA, и три клипа, взятые из MusicLM. Как генерация, так и поиск выполняются с помощью вложений MuLan. Визуально заметно сходство спектрограмм в одном ряду.

На промежуточном этапе к исследованию присоединился MusicLM. Эта модель, разработанная Google, генерирует музыку на основе текстовых описаний. Он, как и фМРТ, измеряет такие факторы, как инструментарий, ритм и эмоции.

Исследователи связали базу данных MusicLM с показаниями фМРТ, что позволило их модели ИИ реконструировать музыку, которую слышали испытуемые. Вместо текстовых инструкций активность мозга обеспечивала контекст для музыкального вывода.

По нашим оценкам реконструированная музыка семантически напоминает оригинальный музыкальный источник.

Созданная музыка напоминает музыкальные стимулы, которые испытали люди, в отношении семантических свойств, таких как жанр, инструменты и настроение. Кроме того, они определили области мозга, отражающие информацию, поступающую из текстовых описаний музыки

Созданная музыка напоминает музыкальные стимулы, которые испытали люди, в отношении семантических свойств, таких как жанр, инструменты и настроение. Кроме того, они определили области мозга, отражающие информацию, поступающую из текстовых описаний музыки

— Тимо Денк, исследователь из Google, один из нескольких авторов статьи.

Авторы назвали созданную модель ИИ Brain2Music.

Созданная музыка напоминает музыкальные стимулы, которые испытали люди, в отношении семантических свойств, таких как жанр, инструменты и настроение. Кроме того, ученые определили области мозга, отражающие информацию, поступающую из текстовых описаний музыки.

Примеры, предоставленные командой, демонстрируют удивительно похожее звучание музыкальных отрывков, интерпретируемых Brain2Music на основе мозговых волн испытуемых.

Одна из семплированных песен присутствовала среди первых 10 лучших хитов 2000 года «Oops!.. I Did It Again» Бритни Спирс. Ряд музыкальных элементов песни, таких как звучание инструментов и ритм, точно соответствовали друг другу, хотя тексты были неразборчивы. Исследователи объяснили, что Brain2Go фокусируется на инструментовке и стиле, а не на текстах.

Это исследование впервые дает количественную интерпретацию с биологической точки зрения. Однако, несмотря на успехи в моделях преобразования текста в музыку, внутренние процессы, отвечающие за это все еще плохо изучены

— Тимо Денк.

ИИ еще не готов проникнуть в наш мозг и записать идеально оркестрованные мелодии, но этот день может быть не за горами.

По словам Денка, будущая работа над моделями генерации музыки улучшит временное согласование между реконструкцией и стимулом. Он также предположил, что в будущем появятся еще более точные методы воспроизведения музыкальных композиций, основанные на чистом воображении.

Возможно, будущим авторам песен нужно будет только представить припев песни, пока принтер, подключенный по беспроводной связи к слуховой коре, распечатывает партитуру.

Так Пол Маккартни, автор песни «Yesterday», признанной в опросе BBC в 1999 году лучшей песней 20-го века, рассказывал, что идея этой песни пришла к нему во сне, однако ему потребовалось полтора года, чтобы заполнить все недостающие части. Если будущий Маккартни придумает потенциальный глобальный хит в полуночном сне, вполне возможно, что модель типа Brain2Go обеспечит полный, быстрый и точный рендеринг композиции уже утром.

- Алексей Павлов

- arXiv

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Ельцин не должен был победить: кого Горбачев хотел сделать президентом России?

Почему этот план с самого начала был обречен на поражение?...

Судьба имперских субмарин решена: почему они останутся на дне Крыма навсегда?

Как военные судна вообще оказались затоплены и кто мешал их изучению долгие десятилетия?...

Токийская декларация-1993: какую бомбу заложил Ельцин под Россию?

Эксперты говорят: российский президент хотел переиграть Токио, но в итоге дал японцам мощный рычаг воздействия на нашу страну...

140 стрел и пепел раскрыли тайну гибели самого загадочного города Руси, Гнездово

Город не зачах, не был расселен из-за политических разборок, его уничтожили быстро и жестоко...

Почему у самого большого железного метеорита на Земле вообще нет кратера?

Астрофизики говорят: метеорит Хоба в Намибии нарушает все правила природы вот уже 80 000 лет...

Стало известно о 9000-летней строительной технологии, которую почти невозможно повторить даже сейчас

Древним секретом активно интересуются сразу две ведущие промышленные организации в Израиле. Интересно, почему?...

Архив ФСБ раскрыл детали одной из самых дерзких диверсионных операций ВОВ

Биография Кирилла Орловского поражает. Две Звезды Героя, друг писателя Хемингуэя, ликвидатор нацистских палачей, председатель лучшего колхоза СССР...

Удар, который едва не расколол Луну пополам: кратер в 1/10 площади планеты оставил не просто астероид

Столкновение было настолько мощным, что на поверхность выбросило породы с глубины… почти 100 километров!...

Биоинженер провел 100 дней под водой. По его словам, это прибавило ему 10 лет жизни

Почему этот эксперимент вызвал массу критики? Кто победит, официальная теория или опытная практика?...

Правительство США рассекретило почти 200 файлов о неопознанных воздушных явлениях

Американские власти и Пентагон признаются: по большинству фактов нет однозначных решений. Почему?...

Иран «ставит на счетчик» мировой интернет: сможет ли Тегеран заставить Запад платить за кабели в Ормузе?

Как оказалось, нефть была только началом. Теперь Тегеран берет за горло западную цифровую экономику...

Выяснилось: как британская разведка создала миф о Распутине, чтобы потом его убить

Еще одна история о том, что Англия во всем времена была главным врагом России...