Этичность и дезинформация: эксперты обсудили проблемы, возникающие при работе с большими языковыми моделями

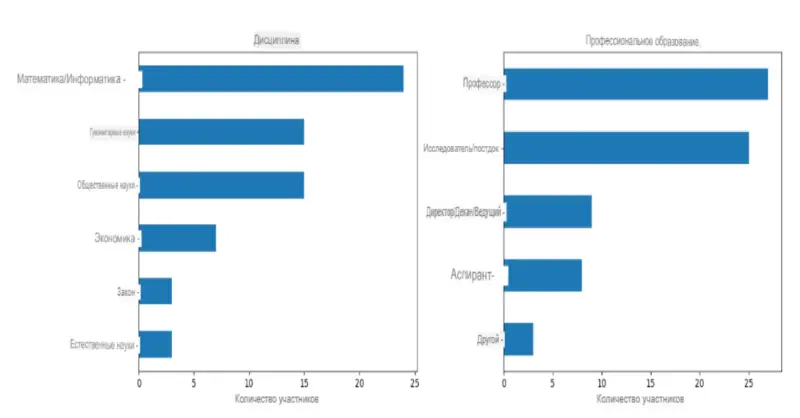

Большие языковые модели (Large Language Model, LLM), используемые, в том числе, в ChatGPT, способны произвести революцию в науке. Таков вывод исследования, проведенного институтом Александра фон Гумбольдта. В нём приняли участие 72 международных эксперта, специализирующихся в области искусственного интеллекта и цифровизации.

Респонденты отмечают, что положительное влияние LLM на научную среду сильно перевешивает негативное. В то же время они подчеркивают важность принятия мер по борьбе с возможной дезинформацией со стороны LLM, чтобы сохранить доверие к научным исследованиям. Поэтому они призывают к регулированию, прозрачности и новым этическим стандартам использования генеративного ИИ.

По мнению респондентов, LLM способны генерировать ложные научные утверждения, которые на первый взгляд неотличимы от подлинных результатов исследований. Эта дезинформация может озвучиваться в публичных дебатах и влиять на политические решения, оказывая негативное влияние на общество. Точно так же ложные данные из больших языковых моделей могут включать в создаваемые тексты различные расистские и дискриминационные стереотипы. Эти ошибки могут проникнуть в научные дебаты, если исследователи будут включать контент, созданный LLM, в свою повседневную работу без тщательной проверки.

Чтобы преодолеть эти проблемы, исследователи должны уметь критически относиться к работе LLM. Из-за увеличения количества дезинформации учёным необходимо использовать свой опыт, авторитет и репутацию для продвижения объективного публичного дискурса. Они должны выступать за более строгие правовые нормы, повышение прозрачности данных обучения, а также за культивирование ответственных и этичных методов использования генеративного ИИ в науке.

По мнению экспертов, положительный эффект наиболее заметен в текстовой части академической работы. В будущем большие языковые модели повысят эффективность исследований за счет автоматизации различных задач, связанных с написанием и публикацией статей. Точно так же они могут избавить ученых от растущей административной отчетности.

В результате такой помощи освобождается время для дальнейших инноваций, так как исследователи смогут уделить основное внимание на содержание своих исследований и при этом эффективно донести его до более широкой аудитории.

— Доктор Бенедикт Фехер, автор исследования «Друг или враг? Изучение влияния больших языковых моделей на науку».

Респонденты отмечают, что положительное влияние LLM на научную среду сильно перевешивает негативное. В то же время они подчеркивают важность принятия мер по борьбе с возможной дезинформацией со стороны LLM, чтобы сохранить доверие к научным исследованиям. Поэтому они призывают к регулированию, прозрачности и новым этическим стандартам использования генеративного ИИ.

Генерация лжи

По мнению респондентов, LLM способны генерировать ложные научные утверждения, которые на первый взгляд неотличимы от подлинных результатов исследований. Эта дезинформация может озвучиваться в публичных дебатах и влиять на политические решения, оказывая негативное влияние на общество. Точно так же ложные данные из больших языковых моделей могут включать в создаваемые тексты различные расистские и дискриминационные стереотипы. Эти ошибки могут проникнуть в научные дебаты, если исследователи будут включать контент, созданный LLM, в свою повседневную работу без тщательной проверки.

Чтобы преодолеть эти проблемы, исследователи должны уметь критически относиться к работе LLM. Из-за увеличения количества дезинформации учёным необходимо использовать свой опыт, авторитет и репутацию для продвижения объективного публичного дискурса. Они должны выступать за более строгие правовые нормы, повышение прозрачности данных обучения, а также за культивирование ответственных и этичных методов использования генеративного ИИ в науке.

Союзник или враг?

По мнению экспертов, положительный эффект наиболее заметен в текстовой части академической работы. В будущем большие языковые модели повысят эффективность исследований за счет автоматизации различных задач, связанных с написанием и публикацией статей. Точно так же они могут избавить ученых от растущей административной отчетности.

В результате такой помощи освобождается время для дальнейших инноваций, так как исследователи смогут уделить основное внимание на содержание своих исследований и при этом эффективно донести его до более широкой аудитории.

Результаты исследования указывают на огромный потенциал больших языковых моделей. Хотя их преимущества перевешивают риски, мнения экспертов в области ИИ и цифровизации показывают, что важно решать проблемы, связанные с дезинформацией и потерей доверия к науке. Если мы будем относиться к LLM ответственно и придерживаться этических принципов, то мы сможем использовать их для максимизации положительного воздействия и минимизации потенциального вреда

— Доктор Бенедикт Фехер, автор исследования «Друг или враг? Изучение влияния больших языковых моделей на науку».

- Алексей Павлов

- Institut für Internet und Gesellschaft

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Ельцин не должен был победить: кого Горбачев хотел сделать президентом России?

Почему этот план с самого начала был обречен на поражение?...

Судьба имперских субмарин решена: почему они останутся на дне Крыма навсегда?

Как военные судна вообще оказались затоплены и кто мешал их изучению долгие десятилетия?...

Токийская декларация-1993: какую бомбу заложил Ельцин под Россию?

Эксперты говорят: российский президент хотел переиграть Токио, но в итоге дал японцам мощный рычаг воздействия на нашу страну...

140 стрел и пепел раскрыли тайну гибели самого загадочного города Руси, Гнездово

Город не зачах, не был расселен из-за политических разборок, его уничтожили быстро и жестоко...

Почему у самого большого железного метеорита на Земле вообще нет кратера?

Астрофизики говорят: метеорит Хоба в Намибии нарушает все правила природы вот уже 80 000 лет...

Стало известно о 9000-летней строительной технологии, которую почти невозможно повторить даже сейчас

Древним секретом активно интересуются сразу две ведущие промышленные организации в Израиле. Интересно, почему?...

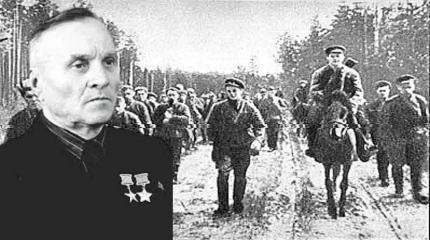

Архив ФСБ раскрыл детали одной из самых дерзких диверсионных операций ВОВ

Биография Кирилла Орловского поражает. Две Звезды Героя, друг писателя Хемингуэя, ликвидатор нацистских палачей, председатель лучшего колхоза СССР...

Удар, который едва не расколол Луну пополам: кратер в 1/10 площади планеты оставил не просто астероид

Столкновение было настолько мощным, что на поверхность выбросило породы с глубины… почти 100 километров!...

Биоинженер провел 100 дней под водой. По его словам, это прибавило ему 10 лет жизни

Почему этот эксперимент вызвал массу критики? Кто победит, официальная теория или опытная практика?...

Правительство США рассекретило почти 200 файлов о неопознанных воздушных явлениях

Американские власти и Пентагон признаются: по большинству фактов нет однозначных решений. Почему?...

Выяснилось: как британская разведка создала миф о Распутине, чтобы потом его убить

Еще одна история о том, что Англия во всем времена была главным врагом России...

Иран «ставит на счетчик» мировой интернет: сможет ли Тегеран заставить Запад платить за кабели в Ормузе?

Как оказалось, нефть была только началом. Теперь Тегеран берет за горло западную цифровую экономику...