Роботы, которые слышат: обучение машин-помощников на платформе Sonicverse

Роботы с искусственным интеллектом становятся все более сложными и постепенно внедряются в повседневное окружение, включая торговые центры, аэропорты, больницы и другие общественные места. В будущем эти роботы могут также помогать людям с домашними делами, офисными поручениями и другими утомительными или трудоемкими задачами.

Однако прежде чем их можно будет полноценно использовать в реальных условиях, алгоритмы искусственного интеллекта, управляющие их движениями и позволяющие им решать поставленные задачи, необходимо обучить и протестировать в смоделированных средах. Хотя в настоящее время существует огромное количество платформ для обучения, очень немногие из них учитывают звуковое пространство, значение которого для человека игнорировать невозможно.

Группа исследователей из Стэнфордского университета недавно создала платформу Sonicverse — виртуальную среду для обучения искусственного интеллекта, которая включает в себя как визуальные, так и аудиальные элементы. Эта платформа, представленная на конференции по робототехнике ICRA 2023, может значительно упростить обучение алгоритмов, предназначенных для работы роботов, которые полагаются как на камеры, так и на микрофоны для навигации по своему окружению.

Sonicverse, платформа, созданная Руоханом Гао и его коллегами, моделирует как визуальные элементы заданной среды, так и звуки, которые искусственный интеллект уловит, исследуя эту среду. Учёные надеялись, что это поможет обучать роботов более эффективно и в более «реалистичных» виртуальных пространствах, улучшая их последующую производительность в нашем мире.

— Руохан Гао, один из создателей Sonicverse.

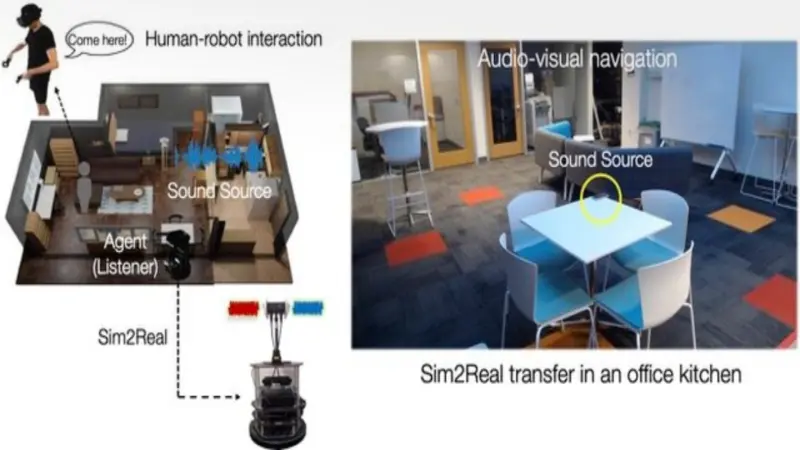

Чтобы протестировать свою платформу, исследователи использовали ее для обучения виртуальной версии TurtleBot, робота от компании Willow Garage, созданного для наиболее эффективного перемещения в помещении и избегающего столкновений с препятствиями. Затем они применили обученный в симуляции ИИ к реальному TurtleBot и протестировали его аудиовизуальные возможности навигации в офисной среде.

— Руохан Гао.

Результаты тестов, проведенных исследователями, весьма многообещающи: их платформа моделирования может обучать роботов более эффективно решать реальные задачи, используя как визуальные, так и слуховые стимулы. Платформа Sonicverse теперь доступна онлайн и вскоре может использоваться другими командами исследователей для обучения и тестирования машин, работающих на искусственном интеллекте.

— Руохан Гао.

Однако прежде чем их можно будет полноценно использовать в реальных условиях, алгоритмы искусственного интеллекта, управляющие их движениями и позволяющие им решать поставленные задачи, необходимо обучить и протестировать в смоделированных средах. Хотя в настоящее время существует огромное количество платформ для обучения, очень немногие из них учитывают звуковое пространство, значение которого для человека игнорировать невозможно.

Группа исследователей из Стэнфордского университета недавно создала платформу Sonicverse — виртуальную среду для обучения искусственного интеллекта, которая включает в себя как визуальные, так и аудиальные элементы. Эта платформа, представленная на конференции по робототехнике ICRA 2023, может значительно упростить обучение алгоритмов, предназначенных для работы роботов, которые полагаются как на камеры, так и на микрофоны для навигации по своему окружению.

Бесшумное прошлое искусственного интеллекта

Sonicverse, платформа, созданная Руоханом Гао и его коллегами, моделирует как визуальные элементы заданной среды, так и звуки, которые искусственный интеллект уловит, исследуя эту среду. Учёные надеялись, что это поможет обучать роботов более эффективно и в более «реалистичных» виртуальных пространствах, улучшая их последующую производительность в нашем мире.

В то время как мы, люди, воспринимаем мир как зрением, так и слухом, очень немногие предыдущие работы касались обучения с помощью звука. Существующие симуляторы либо предполагают, что окружающая среда бесшумна и роботы не могут обнаружить звук, либо используют аудиовизуальные алгоритмы только в симуляции.

Наша цель состояла в том, чтобы представить новую платформу с реалистичной интегрированной аудиовизуальной симуляцией для обучения такого робота, который может и видеть, и слышать.

Sonicverse — это новая платформа мультисенсорного моделирования, которая воссоздаёт непрерывный рендеринг звука в трехмерной среде в режиме реального времени. Она может служить испытательным полигоном для многих задач искусственного интеллекта и взаимодействия человека и робота, например для аудиовизуальной навигации

Наша цель состояла в том, чтобы представить новую платформу с реалистичной интегрированной аудиовизуальной симуляцией для обучения такого робота, который может и видеть, и слышать.

Sonicverse — это новая платформа мультисенсорного моделирования, которая воссоздаёт непрерывный рендеринг звука в трехмерной среде в режиме реального времени. Она может служить испытательным полигоном для многих задач искусственного интеллекта и взаимодействия человека и робота, например для аудиовизуальной навигации

— Руохан Гао, один из создателей Sonicverse.

Тесты на черепахах

Чтобы протестировать свою платформу, исследователи использовали ее для обучения виртуальной версии TurtleBot, робота от компании Willow Garage, созданного для наиболее эффективного перемещения в помещении и избегающего столкновений с препятствиями. Затем они применили обученный в симуляции ИИ к реальному TurtleBot и протестировали его аудиовизуальные возможности навигации в офисной среде.

Мы продемонстрировали возможности Sonicverse с помощью перенесения результатов обучения из симуляции в реальные условия, чего не удалось достичь с помощью других аудиовизуальных симуляторов. Другими словами, мы показали, что робот, обученный на нашем симуляторе, может успешно выполнять аудиовизуальную навигацию в реальных условиях, например, в офисе

— Руохан Гао.

Перспективы аудиовизуальных симуляций

Результаты тестов, проведенных исследователями, весьма многообещающи: их платформа моделирования может обучать роботов более эффективно решать реальные задачи, используя как визуальные, так и слуховые стимулы. Платформа Sonicverse теперь доступна онлайн и вскоре может использоваться другими командами исследователей для обучения и тестирования машин, работающих на искусственном интеллекте.

Такое комплексное обучение имеет огромный потенциал для создания новых полезных функций домашних роботов в будущем. В наших следующих исследованиях мы планируем интегрировать куда больше мультисенсорных объектов в симуляции, чтобы мы могли моделировать сигналы как на уровне окружения, так и на уровне объектов, а также включать другие сенсорные воздействия, например, тактильное восприятие

— Руохан Гао.

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Ельцин не должен был победить: кого Горбачев хотел сделать президентом России?

Почему этот план с самого начала был обречен на поражение?...

Судьба имперских субмарин решена: почему они останутся на дне Крыма навсегда?

Как военные судна вообще оказались затоплены и кто мешал их изучению долгие десятилетия?...

Токийская декларация-1993: какую бомбу заложил Ельцин под Россию?

Эксперты говорят: российский президент хотел переиграть Токио, но в итоге дал японцам мощный рычаг воздействия на нашу страну...

140 стрел и пепел раскрыли тайну гибели самого загадочного города Руси, Гнездово

Город не зачах, не был расселен из-за политических разборок, его уничтожили быстро и жестоко...

Почему у самого большого железного метеорита на Земле вообще нет кратера?

Астрофизики говорят: метеорит Хоба в Намибии нарушает все правила природы вот уже 80 000 лет...

Стало известно о 9000-летней строительной технологии, которую почти невозможно повторить даже сейчас

Древним секретом активно интересуются сразу две ведущие промышленные организации в Израиле. Интересно, почему?...

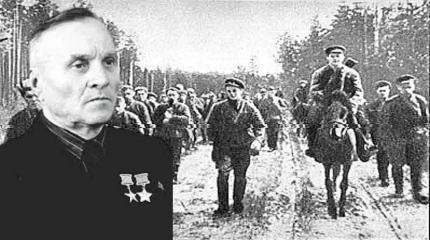

Архив ФСБ раскрыл детали одной из самых дерзких диверсионных операций ВОВ

Биография Кирилла Орловского поражает. Две Звезды Героя, друг писателя Хемингуэя, ликвидатор нацистских палачей, председатель лучшего колхоза СССР...

Удар, который едва не расколол Луну пополам: кратер в 1/10 площади планеты оставил не просто астероид

Столкновение было настолько мощным, что на поверхность выбросило породы с глубины… почти 100 километров!...

Биоинженер провел 100 дней под водой. По его словам, это прибавило ему 10 лет жизни

Почему этот эксперимент вызвал массу критики? Кто победит, официальная теория или опытная практика?...

Правительство США рассекретило почти 200 файлов о неопознанных воздушных явлениях

Американские власти и Пентагон признаются: по большинству фактов нет однозначных решений. Почему?...

Выяснилось: как британская разведка создала миф о Распутине, чтобы потом его убить

Еще одна история о том, что Англия во всем времена была главным врагом России...

Иран «ставит на счетчик» мировой интернет: сможет ли Тегеран заставить Запад платить за кабели в Ормузе?

Как оказалось, нефть была только началом. Теперь Тегеран берет за горло западную цифровую экономику...