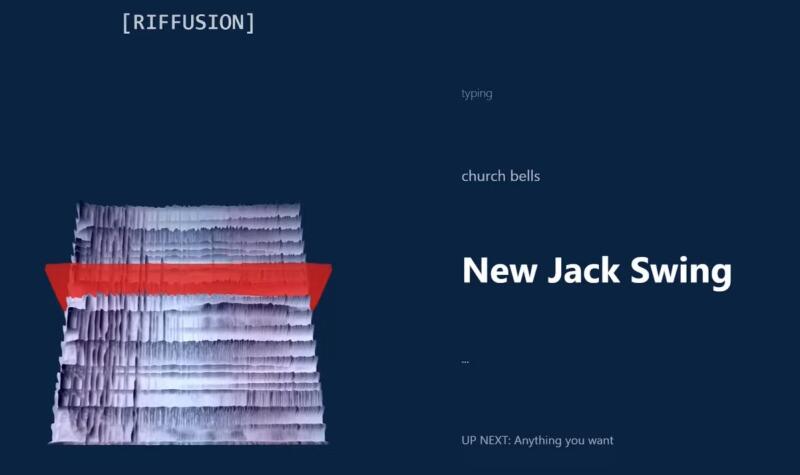

Модель ИИ Riffusion сочиняет музыку на основе визуализаций

Музыка, созданная искусственным интеллектом (ИИ) — это уже достаточно инновационная концепция. Но разработка Riffusion выводит её на новый уровень: создаёт музыку, взяв за пример не звуки, а их изображения.

Diffusion — технология машинного обучения для создания изображений, которая за последний год обогатила мир ИИ. Две самые известные модели — это DALL-E 2 и Stable Diffusion. Метод доказал свою эффективность в разных направлениях и очень удобен для тонкой настройки. То есть обученной модели можно задать вводные, чтобы она создала больше примеров похожего контента.

То, что Сет Форсгрен и Айк Мартирос сделали для своего хобби-проекта Riffusion — это тонкая настройка «Стабильной диффузии» по спектрограммам.

— Сет Форсгрен, разработчик Riffusion.

Спектрограммы — это визуальные отображения звука, которые показывают амплитуду разных частот. Форсгрен и Мартирос приготовили спектрограммы музыки и назвали полученные изображения соответствующе: «блюзовая гитара», «джазовое пианино», «афробит» и тому подобное. После ввода в модель этой коллекции, ИИ «получил представление» о том, как «выглядят» определённые звуки и как их можно воспроизводить или комбинировать.

Модель оказалась способной обрабатывать спектрограммы и выдавать звук, соответствующий подсказкам, таким как «фанковое пианино», «джазовый саксофон» и так далее. В проекте Riffusion обнаружили, что если ИИ задали, например, подсказки «церковные колокола» и «электронные ритмы», программа постепенно и «естественно» переходит от одной к другой, и даже в такт. Получается странный, интересный звук, хотя и не особенно сложный или точный, отметил обозреватель TechCrunch.

Словно оправдываясь, Форсгрен пояснил, что «тренеры» ИИ не пытались создать классическую трёхминутную песню с повторяющимися припевами и куплетами. Для этого, вероятно, нужно построить модель более высокого уровня.

Собственный вывод «Вслух.net» — сайт Riffusion.com получился занятной онлайн-игрушкой для знающих толк в музыке и к тому же интересующихся достижениями ИИ.

Diffusion — технология машинного обучения для создания изображений, которая за последний год обогатила мир ИИ. Две самые известные модели — это DALL-E 2 и Stable Diffusion. Метод доказал свою эффективность в разных направлениях и очень удобен для тонкой настройки. То есть обученной модели можно задать вводные, чтобы она создала больше примеров похожего контента.

То, что Сет Форсгрен и Айк Мартирос сделали для своего хобби-проекта Riffusion — это тонкая настройка «Стабильной диффузии» по спектрограммам.

Мы с Айком играем в небольшой группе. И проект начали просто потому, что любим музыку и не знали, возможно ли вообще в Stable Diffusion использовать спектрограмму для преобразования в звук

— Сет Форсгрен, разработчик Riffusion.

Спектрограммы — это визуальные отображения звука, которые показывают амплитуду разных частот. Форсгрен и Мартирос приготовили спектрограммы музыки и назвали полученные изображения соответствующе: «блюзовая гитара», «джазовое пианино», «афробит» и тому подобное. После ввода в модель этой коллекции, ИИ «получил представление» о том, как «выглядят» определённые звуки и как их можно воспроизводить или комбинировать.

Модель оказалась способной обрабатывать спектрограммы и выдавать звук, соответствующий подсказкам, таким как «фанковое пианино», «джазовый саксофон» и так далее. В проекте Riffusion обнаружили, что если ИИ задали, например, подсказки «церковные колокола» и «электронные ритмы», программа постепенно и «естественно» переходит от одной к другой, и даже в такт. Получается странный, интересный звук, хотя и не особенно сложный или точный, отметил обозреватель TechCrunch.

Словно оправдываясь, Форсгрен пояснил, что «тренеры» ИИ не пытались создать классическую трёхминутную песню с повторяющимися припевами и куплетами. Для этого, вероятно, нужно построить модель более высокого уровня.

Собственный вывод «Вслух.net» — сайт Riffusion.com получился занятной онлайн-игрушкой для знающих толк в музыке и к тому же интересующихся достижениями ИИ.

- Дмитрий Ладыгин

- riffusion.com

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Кто убивает итальянских волков: зоологи были потрясены кадрами с автоматической камеры

Трагический эпизод показал, что некоторые зоологические теории придется кардинально пересмотреть. У серых хищников есть неожиданные враги...

Очередной миф Николая Карамзина полностью развеян российскими археологами

Оказалось, что Иван Грозный не убивал супругу своего младшего брата. Напротив, с княгиней Ульянией Углицкой случалась куда более таинственная и запутанная...

Самая запрещенная русская сказка: почему «Курочку Рябу» не любили ни цари, ни руководители СССР?

Чтобы эту историю можно было рассказывать советским детям, ее сюжет пришлось изменить самым радикальным образом. Но, может быть, это и к лучшему...

Американский «Чернобыль-80»: эта катастрофа едва не изменила всю историю США

Эксперты говорят: лишь счастливая случайность не позволила взорваться заряду в 600 (!) раз мощнее хиросимской бомбы...

80 лет без Звезды Героя: почему офицер, поставивший Знамя Победы, не получил заслуженную награду при жизни?

Только указ Президента России смог исправить одну из самых вопиющих несправедливостей в советской истории...

Гениальное ДНК-«мошенничество»: ученые раскрыли секрет рыбы, которая плевать хотела на главные законы биологии

100 000 лет успешного клонирования: амазонская моллинезия просто... копирует себя. И при этом удивительно успешно ремонтируют поврежденные гены, насмехаясь над...

Почему на Иран обрушился черный дождь и насколько он опасен?

Экологи говорят: агрессивные действия США и Израиля поставили под угрозу здоровье миллионов людей по всей планете...

Каменный топор со дна реки может переписать древнейшую историю Сибири

По словам ученых, получился отличный научный детектив: добыча золота, артефакт бронзового века, забытая цивилизация...

Японец 26 лет ждал, пока раскроют убийство его жены. Часть 2. Расплата

Как наука отменила срок давности у преступления? И какая тайна осталась не раскрытой?...

Японец 26 лет ждал, пока раскроют убийство его жены

Как новейшие технологии помогли сдвинуть с места нераскрываемое дело...

Главный секрет человеческого дыхания: ученые рассказали, почему мы дышим «вахтовым методом»

Эксперты предупреждают: из-за особенности организма многие люди не смогут попасть в космос. Но решение все-таки есть...

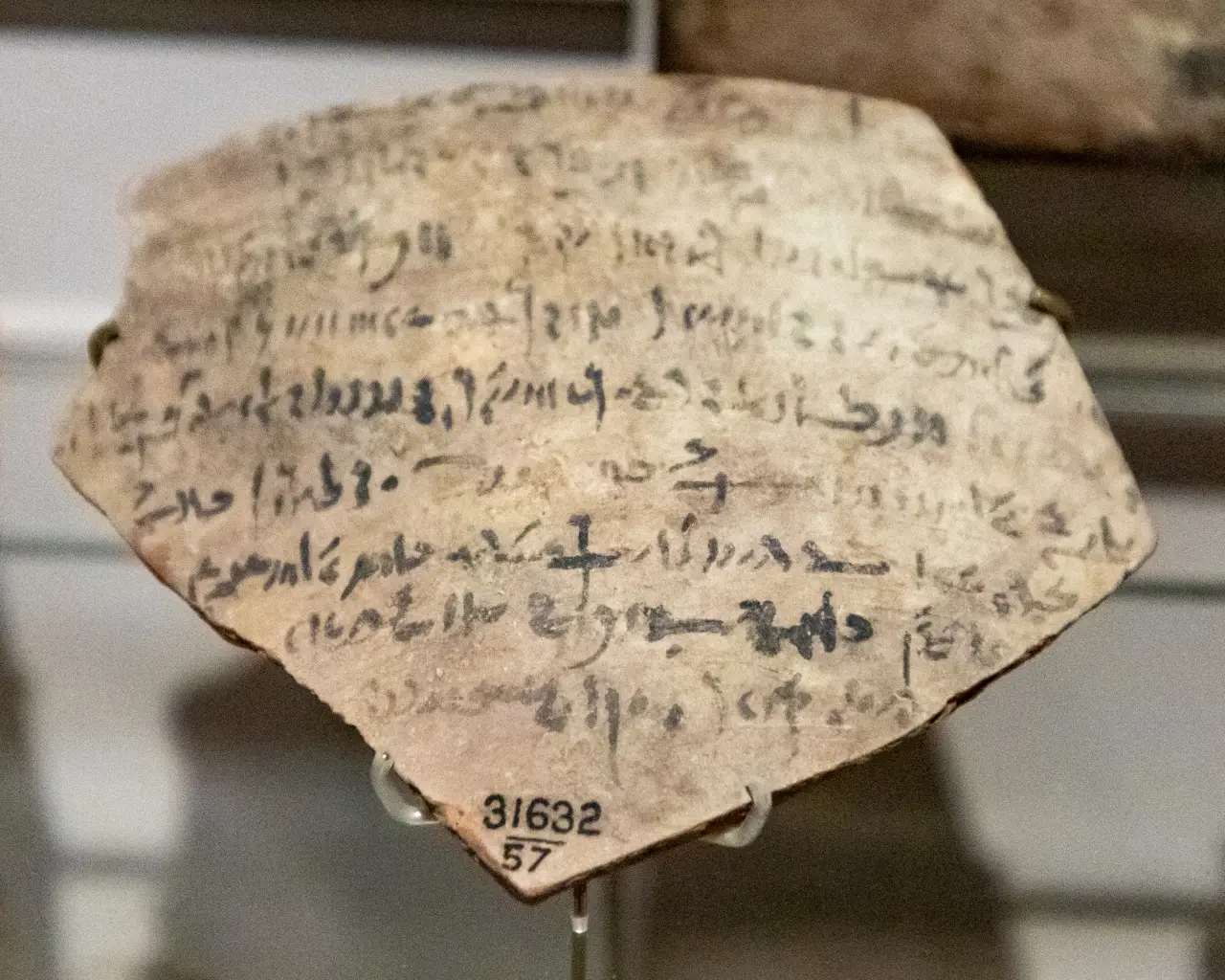

43 000 черепков открыли тысячелетние тайны Древнего Египта

Почему глиняная библиотека Атрибиса потрясла весь археологический мир?...