OpenAI формирует команду, чтобы обуздать сверхинтеллектуальный ИИ

OpenAI исследовательская лаборатория, занимающаяся разработкой искусственного интеллекта (ИИ), в последнее время стала известна всему миру благодаря прорыву в разработке интеллектуальных ботов. На данный момент команада работает над созданием искусственного интеллекта, который во многих областях сможет превзойти человеческий. Такой ИИ называется суперинтеллектом и, по мнению OpenAI, может появиться уже в этом десятилетии.

Очевидно, суперинтеллект может представлять угрозу для человечества, если он не будет контролироваться и направляться в соответствии с человеческими ценностями. Именно поэтому OpenAI объявила о создании новой команды, которая будет заниматься проблемой суперсоответствия — то есть обеспечением того, чтобы суперинтеллект действовал в интересах людей.

Так называемая команда суперсоответствия будет возглавляться Ильей Суцкевером, главным научным сотрудником и одним из сооснователей OpenAI, и Яном Лейке, руководителем команды по выравниванию ИИ в OpenAI. Кроме того, OpenAI выделит 20% своих вычислительных ресурсов для этого проекта. Цель команды — разработать автоматизированного исследователя по суперсоответствию, который будет помогать OpenAI в оценке и регулировании суперинтеллекта. Гипотеза OpenAI заключается в том, что ИИ может делать более быстрые и лучшие исследования по суперсоответствию, чем люди.

— Илья Суцкевер.

Формирование команды суперсоответствия происходит на фоне обсуждения вопроса о регулировании индустрии ИИ на государственном уровне. Генеральный директор OpenAI Сэм Альтман встретился по крайней мере со 100 федеральными законодателями США в последние месяцы. Он заявил, что регулирование ИИ является «необходимым» и что OpenAI «готова» сотрудничать с политиками.

Однако, несмотря на позитивный настрой, стоит скептично отнестись к заявлениям разработчиков, и инициативе по созданию команды контроля со стороны OpenAI. Сосредотачивая внимание общественности на гипотетических рисках, которые могут никогда не реализоваться, OpenAI перекладывает бремя регулирования на горизонт будущего, а также, возможно, стремится создавать видимость контроля. Есть гораздо более актуальные проблемы, связанные с взаимодействием ИИ и труда, дезинформации и авторских прав, которые должны быть решены уже сегодня.

Учитывая то, насколько создатели систем ИИ оказались способны предугадать и предотвратить уже возникшие благодаря их разработкам проблемы, возникают сомнения либо в их аналитических способностях, либо, в чистоте намерений. Можно предположить, что если от суперинтеллекта нас попытаются уберечь те же люди, человечество, вероятно, обречено.

Очевидно, суперинтеллект может представлять угрозу для человечества, если он не будет контролироваться и направляться в соответствии с человеческими ценностями. Именно поэтому OpenAI объявила о создании новой команды, которая будет заниматься проблемой суперсоответствия — то есть обеспечением того, чтобы суперинтеллект действовал в интересах людей.

Команда по спасению мира

Так называемая команда суперсоответствия будет возглавляться Ильей Суцкевером, главным научным сотрудником и одним из сооснователей OpenAI, и Яном Лейке, руководителем команды по выравниванию ИИ в OpenAI. Кроме того, OpenAI выделит 20% своих вычислительных ресурсов для этого проекта. Цель команды — разработать автоматизированного исследователя по суперсоответствию, который будет помогать OpenAI в оценке и регулировании суперинтеллекта. Гипотеза OpenAI заключается в том, что ИИ может делать более быстрые и лучшие исследования по суперсоответствию, чем люди.

Хотя это невероятно амбициозная цель и мы не можем гарантировать успех, мы оптимистично настроены на то, что сосредоточенные усилия могут решить эту проблему. Есть много идей, которые показали свою перспективность в предварительных экспериментах, у нас есть постоянно обновляемые метрики для отслеживания прогресса, и мы можем использовать современные модели ИИ для эмпирического изучения многих из этих проблем

— Илья Суцкевер.

Формирование команды суперсоответствия происходит на фоне обсуждения вопроса о регулировании индустрии ИИ на государственном уровне. Генеральный директор OpenAI Сэм Альтман встретился по крайней мере со 100 федеральными законодателями США в последние месяцы. Он заявил, что регулирование ИИ является «необходимым» и что OpenAI «готова» сотрудничать с политиками.

Однако, несмотря на позитивный настрой, стоит скептично отнестись к заявлениям разработчиков, и инициативе по созданию команды контроля со стороны OpenAI. Сосредотачивая внимание общественности на гипотетических рисках, которые могут никогда не реализоваться, OpenAI перекладывает бремя регулирования на горизонт будущего, а также, возможно, стремится создавать видимость контроля. Есть гораздо более актуальные проблемы, связанные с взаимодействием ИИ и труда, дезинформации и авторских прав, которые должны быть решены уже сегодня.

Учитывая то, насколько создатели систем ИИ оказались способны предугадать и предотвратить уже возникшие благодаря их разработкам проблемы, возникают сомнения либо в их аналитических способностях, либо, в чистоте намерений. Можно предположить, что если от суперинтеллекта нас попытаются уберечь те же люди, человечество, вероятно, обречено.

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

«Цирк Шубикова» с бомбами: как в СССР создали «невозможный» авианосец

Самолеты атаковали противника, срываясь с летающей авиабазы. Это пытались сделать и США, и Германия, но получилось только у Советского Союза...

Медный парадокс: почему электричество никогда не придет в каждый дом

Эксперты считают, что развитие цивилизации уперлось в мощный геологический барьер. Кто виноват и как выходить из этой ситуации?...

Тайна разгадана: почему люди — это единственные приматы с подбородком

Оказалось, что эволюция действует не так, как столетиями считали ученые...

«Проклятие» Романовых: отчего на самом деле умер брат Петра I, царь Федор?

Российские ученые разгадали болезнь, которая свела в могилу старшую ветвь царской семьи...

Обнаружены, но обречены: кто угрожает гробницам, которые старше первых пирамид?

6000-летняя культура, обнаруженная спутниками, была уникальной. Она застала времена, когда Сахара была еще зеленой...

Новое исследование: Христофор Колумб — вообще не тот, кем его считали историки

Ученые даже назвали подлинное имя великого мореплавателя...

Еще одна тайна Аркаима разгадана: ученые объяснили, почему древний город построен именно на этом месте

Оказалось, что наши далекие предки очень умело использовали природную инфраструктуру и обладали инженерными знаниями...

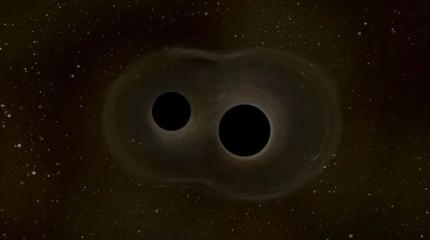

60 млрд Солнц в одной точке: что скрывает самая тяжелая пара черных дыр?

Секрет абсолютной пустоты, похоже, разгадан. Там нет вообще ничего: Ни пыли, ни газа, ни звезд...

Назад в будущее: почему Швеция запрещает смартфоны в школах и возвращается к бумажным учебникам?

По словам экспертов, отмена цифровизации сейчас происходит во многих странах. Неужели человечество одумалось и начинает выздоравливать?...

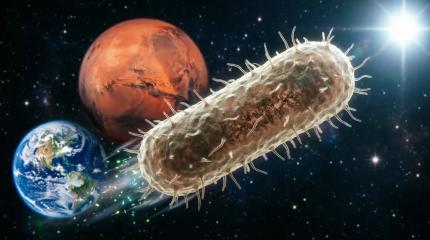

Мы все «марсиане»: ученые доказали, что жизнь с Красной планеты могла долететь за несколько лет

Компьютерное моделирование подтвердило: бактерии способны пережить Великий перенос с Марса на Землю. И этот процесс может идти прямо сейчас...

СССР был первым в энергии ветра: что помешало стать лидером планеты?

Это был невероятный и прорывной проект советского конструктора Юрия Кондратюка. Того самого, по расчетам которого, американцы полетели на Луну...

В тени российского орла: сколько раз Петербург спасал Вашингтон от полной гибели?

Когда-то американцы клялись, что США будет дружить с Россией, покуда светят звезды. А сейчас делают вид, что не помнят...