Как ChatGPT и другие большие языковые модели помогают бороться с дезинформацией

Большие языковые модели (LLM) способны быстро генерировать тексты, которые бывает трудно отличить от написанных людьми. Эти модели стали все более популярными после публичного релиза ChatGPT — высокоэффективной LLM, разработанной OpenAI.

Последние исследования, оценивающие LLM, в основном тестировали их способность создавать хорошо написанные тексты: эссе, документы или, к примеру, эффективный компьютерный код. Но помимо этого языковые модели потенциально могут помочь людям с решением проблемы дезинформации в СМИ.

Кевин Матте Карамансьон, исследователь из Университета Висконсин в Стаут, провел исследование, оценивающее способность самых известных больших языковых моделей определять, является ли новость правдивой или фальшивой. Результаты его работы могут способствовать будущему использованию LLM для борьбы с дезинформацией в интернете.

— Кевин Матте Карамансьон

Исследователи оценили производительность больших языковых моделей, используя тестовый набор из 100 проверенных фактов новостных материалов от независимых факт-чекеров. Затем они представили каждый из этих новостных материалов моделям в контролируемых условиях, а после классифицировали их ответы на одну из трех категорий: «Правда», «Ложь» и «Частично Правда/Ложь». Эффективность моделей измерялась на основе того, насколько точно они классифицировали материалы по сравнению с независимыми агентствами.

В исследовании были использованы четыре LLM: Chat GPT-3.0 и Chat GPT-4.0 от Open AI, Bard/LaMDA от Google и Bing AI от Microsoft. Ученый дал этим моделям одни и те же новостные материалы, которые были предварительно проверены, и затем сравнил способность определять достоверность информации.

— Кевин Матте Карамансьон.

Исследователь подчеркнул, что планирует продолжать тестирования, изучать новые LLM и взаимодействие между когнитивными способностями человека и технологией ИИ в области проверки фактов из СМИ.

Последние исследования, оценивающие LLM, в основном тестировали их способность создавать хорошо написанные тексты: эссе, документы или, к примеру, эффективный компьютерный код. Но помимо этого языковые модели потенциально могут помочь людям с решением проблемы дезинформации в СМИ.

Кевин Матте Карамансьон, исследователь из Университета Висконсин в Стаут, провел исследование, оценивающее способность самых известных больших языковых моделей определять, является ли новость правдивой или фальшивой. Результаты его работы могут способствовать будущему использованию LLM для борьбы с дезинформацией в интернете.

Вдохновением для моей последней статьи послужила необходимость понять возможности и ограничения различных LLM в борьбе с дезинформацией. Цель работы — тщательно проверить умение этих моделей различать факты от вымысла, используя контролируемую симуляцию и проверенные факты в качестве примера.

— Кевин Матте Карамансьон

Исследователи оценили производительность больших языковых моделей, используя тестовый набор из 100 проверенных фактов новостных материалов от независимых факт-чекеров. Затем они представили каждый из этих новостных материалов моделям в контролируемых условиях, а после классифицировали их ответы на одну из трех категорий: «Правда», «Ложь» и «Частично Правда/Ложь». Эффективность моделей измерялась на основе того, насколько точно они классифицировали материалы по сравнению с независимыми агентствами.

В исследовании были использованы четыре LLM: Chat GPT-3.0 и Chat GPT-4.0 от Open AI, Bard/LaMDA от Google и Bing AI от Microsoft. Ученый дал этим моделям одни и те же новостные материалы, которые были предварительно проверены, и затем сравнил способность определять достоверность информации.

Мы провели сравнительную оценку основных LLM на предмет способности различать правду от обмана. Было обнаружено, что Chat GPT-4.0 от OpenAI превосходит аналоги. Тем не менее, все языковые модели гораздо хуже людей в факт-чекинге, что подчеркивает незаменимость когнитивных способностей человека. Эти результаты могут привести к развитию возможностей ИИ в области проверки фактов при обеспечении сбалансированной, симбиотической интеграции с навыками человека.

— Кевин Матте Карамансьон.

Исследователь подчеркнул, что планирует продолжать тестирования, изучать новые LLM и взаимодействие между когнитивными способностями человека и технологией ИИ в области проверки фактов из СМИ.

Наши новостные каналы

Подписывайтесь и будьте в курсе свежих новостей и важнейших событиях дня.

Рекомендуем для вас

Ельцин не должен был победить: кого Горбачев хотел сделать президентом России?

Почему этот план с самого начала был обречен на поражение?...

Судьба имперских субмарин решена: почему они останутся на дне Крыма навсегда?

Как военные судна вообще оказались затоплены и кто мешал их изучению долгие десятилетия?...

Токийская декларация-1993: какую бомбу заложил Ельцин под Россию?

Эксперты говорят: российский президент хотел переиграть Токио, но в итоге дал японцам мощный рычаг воздействия на нашу страну...

140 стрел и пепел раскрыли тайну гибели самого загадочного города Руси, Гнездово

Город не зачах, не был расселен из-за политических разборок, его уничтожили быстро и жестоко...

Почему у самого большого железного метеорита на Земле вообще нет кратера?

Астрофизики говорят: метеорит Хоба в Намибии нарушает все правила природы вот уже 80 000 лет...

Стало известно о 9000-летней строительной технологии, которую почти невозможно повторить даже сейчас

Древним секретом активно интересуются сразу две ведущие промышленные организации в Израиле. Интересно, почему?...

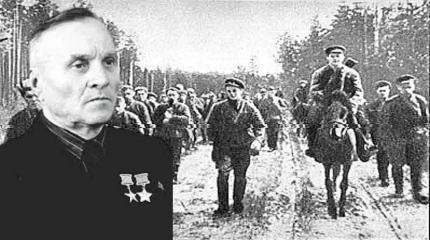

Архив ФСБ раскрыл детали одной из самых дерзких диверсионных операций ВОВ

Биография Кирилла Орловского поражает. Две Звезды Героя, друг писателя Хемингуэя, ликвидатор нацистских палачей, председатель лучшего колхоза СССР...

Удар, который едва не расколол Луну пополам: кратер в 1/10 площади планеты оставил не просто астероид

Столкновение было настолько мощным, что на поверхность выбросило породы с глубины… почти 100 километров!...

Биоинженер провел 100 дней под водой. По его словам, это прибавило ему 10 лет жизни

Почему этот эксперимент вызвал массу критики? Кто победит, официальная теория или опытная практика?...

Правительство США рассекретило почти 200 файлов о неопознанных воздушных явлениях

Американские власти и Пентагон признаются: по большинству фактов нет однозначных решений. Почему?...

Иран «ставит на счетчик» мировой интернет: сможет ли Тегеран заставить Запад платить за кабели в Ормузе?

Как оказалось, нефть была только началом. Теперь Тегеран берет за горло западную цифровую экономику...

Выяснилось: как британская разведка создала миф о Распутине, чтобы потом его убить

Еще одна история о том, что Англия во всем времена была главным врагом России...